GateUser-a43bc48f

用户暂无简介

GateUser-a43bc48f

以前做一套复杂的 DeFi 策略,要懂链、懂协议、会写代码,普通人根本玩不来。但 @Infinit_Labs 马上要开放的“策略生成”功能,真的有点意思,它基本把这个门槛打平了。

他们在内测阶段就验证了一个点:用自然语言写提示语,AI 就能帮你自动生成一整套多步骤的 DeFi 策略。不是随便写写,而是能真正在链上跑起来、还能被执行的那种。而接下来,这个功能会向所有人开放。

意味着什么?只要你脑子里有个靠谱的 DeFi 想法,哪怕你不懂代码,只要你能把逻辑讲清楚,就能让 AI 帮你打包成可执行的策略,发出来之后别人用,你还能赚收益。

这个机制听起来有点像开放式创作平台,但是专为 DeFi 策略服务的。比起以前靠抄别人思路或者追热点,现在是“只要你能想得明白,就能做出来”。这不光能鼓励更多人参与策略创新,还能形成一种正循环——社区里真的会冒出一些实打实能赚钱的策略,不靠炒作,靠的是创意和执行力。

我觉得它本质上是把 DeFi 从“拼技术”变成了“拼创意和表达”,这对整个圈子的影响可能比我们想象的大。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Aptos @0xPolygon 热度也很高

他们在内测阶段就验证了一个点:用自然语言写提示语,AI 就能帮你自动生成一整套多步骤的 DeFi 策略。不是随便写写,而是能真正在链上跑起来、还能被执行的那种。而接下来,这个功能会向所有人开放。

意味着什么?只要你脑子里有个靠谱的 DeFi 想法,哪怕你不懂代码,只要你能把逻辑讲清楚,就能让 AI 帮你打包成可执行的策略,发出来之后别人用,你还能赚收益。

这个机制听起来有点像开放式创作平台,但是专为 DeFi 策略服务的。比起以前靠抄别人思路或者追热点,现在是“只要你能想得明白,就能做出来”。这不光能鼓励更多人参与策略创新,还能形成一种正循环——社区里真的会冒出一些实打实能赚钱的策略,不靠炒作,靠的是创意和执行力。

我觉得它本质上是把 DeFi 从“拼技术”变成了“拼创意和表达”,这对整个圈子的影响可能比我们想象的大。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Aptos @0xPolygon 热度也很高

- 赞赏

- 点赞

- 评论

- 分享

Meta @AIatMeta 又用成绩证明了一件事:社交+AI,这个组合真的太能打了。财报一出来,净利润直接暴涨38%,股价一个晚上拉了10%以上。这背后最核心的收入来源,还是广告。说白了,就是靠 AI 工具帮别人拉客户,然后自己赚得盆满钵满。

现在他们连 ROI 都能通过 AI 提高 22%,这套组合拳也太熟练了。而这,其实就是 Web3 版 UXLINK 正在走的路。社交是底子,5400万用户的网络效应不可能是假的;AI 是引擎,Meta 为了这个方向都砸了140亿美元,下注压得明明白白。

更关键的是,这个市场本身够大。全球广告产业每年几千亿的体量,再加上 Web3 市场 26.5% 的年增长率,光想想就知道这是个长期爆发的方向。

不同的是, @UXLINKofficial 用的是去中心化社交关系网 + 世界第一个 AI 增长体 XerpaAI。这不只是复制 Meta 的路,更像是在用 Web3 的方式重构一套新规则。不是要成为 Web3 的 Meta,而是干脆超越它。

现在他们连 ROI 都能通过 AI 提高 22%,这套组合拳也太熟练了。而这,其实就是 Web3 版 UXLINK 正在走的路。社交是底子,5400万用户的网络效应不可能是假的;AI 是引擎,Meta 为了这个方向都砸了140亿美元,下注压得明明白白。

更关键的是,这个市场本身够大。全球广告产业每年几千亿的体量,再加上 Web3 市场 26.5% 的年增长率,光想想就知道这是个长期爆发的方向。

不同的是, @UXLINKofficial 用的是去中心化社交关系网 + 世界第一个 AI 增长体 XerpaAI。这不只是复制 Meta 的路,更像是在用 Web3 的方式重构一套新规则。不是要成为 Web3 的 Meta,而是干脆超越它。

UXLINK-0.06%

- 赞赏

- 点赞

- 评论

- 分享

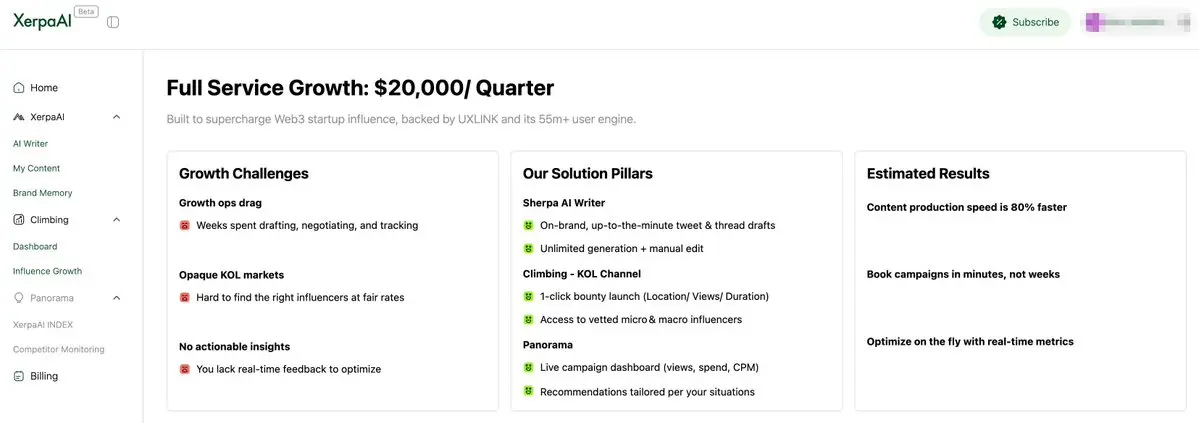

TrustaLabs 成为 @XerpaAI 的首个季度付费用户了,而且用的是 @UXLINKofficial $UXLINK 付款,交易都上链了,透明度拉满。

这不光是一个合作,更像是 XerpaAI AGA(AI Growth Agent)模式被市场认可的信号。Trusta 接入后,不仅能用上 Xerpa 的全套增长工具,还能利用 Influential Index 做更精准的用户策略,等于是把增长这事交给了 AI 来搞定。

更有意思的是,只要是 UXLINK 生态内的项目,用 $UXLINK 支付还能打九折,官方是真的在用实际动作给代币赋能。

我感觉这类合作未来只会越来越多,AI 和社交数据结合搞增长,本身就是 Web3 很稀缺的一环。接下来就看 Trusta 的数据怎么跑起来了。

这不光是一个合作,更像是 XerpaAI AGA(AI Growth Agent)模式被市场认可的信号。Trusta 接入后,不仅能用上 Xerpa 的全套增长工具,还能利用 Influential Index 做更精准的用户策略,等于是把增长这事交给了 AI 来搞定。

更有意思的是,只要是 UXLINK 生态内的项目,用 $UXLINK 支付还能打九折,官方是真的在用实际动作给代币赋能。

我感觉这类合作未来只会越来越多,AI 和社交数据结合搞增长,本身就是 Web3 很稀缺的一环。接下来就看 Trusta 的数据怎么跑起来了。

- 赞赏

- 点赞

- 评论

- 分享

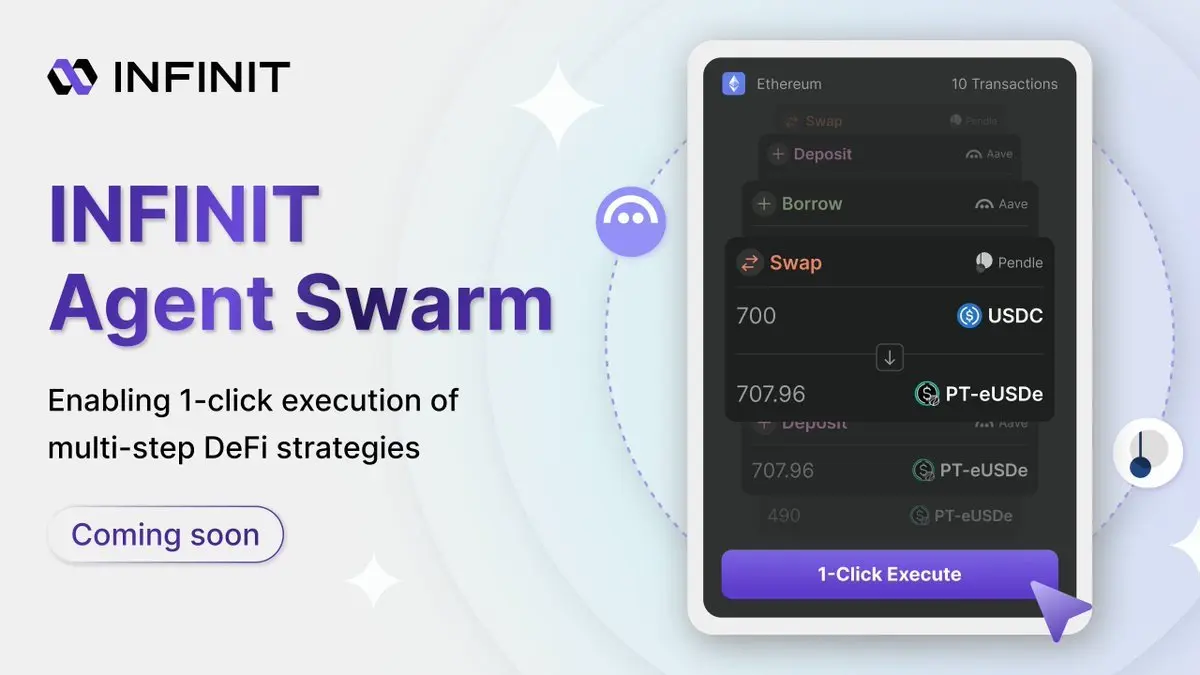

🥳 @Infinit_Labs V2 接下来的路线图,其实可以说是它从“智能助手”变成“执行引擎”的关键阶段。整个升级是围绕三个重点来推进的,但第一步就很有看头:一键执行。

现在大部分 DeFi 操作卡在哪?不是你没策略,是根本懒得动手。一堆链、一堆协议,跨链还得自己桥,批操作都要手动点好几次。INFINIT 搞的这个 Agent Swarm,就是专门解决这个执行门槛的。

未来你看到一个策略,不用研究十几步,只要点一下,底层多个 Agent 会自己协调执行:怎么换币,怎么跨链,怎么拆仓、合仓、套利,全自动。最关键的是资金不需要交出去,操作全程都在你的钱包内完成,还能事前看清楚执行逻辑,不怕被黑箱子收割。

目前这个功能在私测阶段就已经跑过,接下来会逐步开放给更多用户。如果你是那种经常觉得“策略都看懂了,就是懒得操作”的人,INFINIT 这一波可能会让你重新回到链上玩起来。

对我来说,这种体验就像是 DeFi 终于有了自己的“支付宝”——复杂操作都藏在后台,你只管点击,执行这事以后不需要你操心了。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Aptos @0xPolygon 热度也很高

现在大部分 DeFi 操作卡在哪?不是你没策略,是根本懒得动手。一堆链、一堆协议,跨链还得自己桥,批操作都要手动点好几次。INFINIT 搞的这个 Agent Swarm,就是专门解决这个执行门槛的。

未来你看到一个策略,不用研究十几步,只要点一下,底层多个 Agent 会自己协调执行:怎么换币,怎么跨链,怎么拆仓、合仓、套利,全自动。最关键的是资金不需要交出去,操作全程都在你的钱包内完成,还能事前看清楚执行逻辑,不怕被黑箱子收割。

目前这个功能在私测阶段就已经跑过,接下来会逐步开放给更多用户。如果你是那种经常觉得“策略都看懂了,就是懒得操作”的人,INFINIT 这一波可能会让你重新回到链上玩起来。

对我来说,这种体验就像是 DeFi 终于有了自己的“支付宝”——复杂操作都藏在后台,你只管点击,执行这事以后不需要你操心了。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Aptos @0xPolygon 热度也很高

- 赞赏

- 点赞

- 评论

- 分享

Hyperion 自从上线 @Aptos 主网之后,发展速度确实挺猛的。TVL 已经破了 1.3 亿美金,在 Aptos 的 DeFi 项目里直接冲进前十,六月的月交易量也排进全球 DEX 前十二,说明用户是真在用,而且用得挺重的。

背后原因其实也不复杂。现在很多人都在找“又快又便宜”的链,Aptos 本身的性能已经够强,再加上 Hyperion 这种配套设施,就有了组合拳的感觉。不光是换币这件事儿,它还跟像 Kofi Finance、Amnis Finance 这类项目打通了,把质押、流动性、组合策略这些全都接起来了,变成一整个系统。

这种玩法的好处是你不用在各个平台来回跳,一个地方就能完成比较多操作。对用户来说很省心,对协议来说也能更快吸流量、聚资本。

整体来看,Hyperion 已经不只是一个“新 DEX”,而是在 Aptos 上把整个 DeFi 基建拉上了一个新台阶。后续如果 Aptos 继续涨声势,那 Hyperion 很可能就是那个最先吃到红利的玩家之一。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @0xPolygon 热度也很高

背后原因其实也不复杂。现在很多人都在找“又快又便宜”的链,Aptos 本身的性能已经够强,再加上 Hyperion 这种配套设施,就有了组合拳的感觉。不光是换币这件事儿,它还跟像 Kofi Finance、Amnis Finance 这类项目打通了,把质押、流动性、组合策略这些全都接起来了,变成一整个系统。

这种玩法的好处是你不用在各个平台来回跳,一个地方就能完成比较多操作。对用户来说很省心,对协议来说也能更快吸流量、聚资本。

整体来看,Hyperion 已经不只是一个“新 DEX”,而是在 Aptos 上把整个 DeFi 基建拉上了一个新台阶。后续如果 Aptos 继续涨声势,那 Hyperion 很可能就是那个最先吃到红利的玩家之一。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @0xPolygon 热度也很高

- 赞赏

- 点赞

- 评论

- 分享

看到 @TheoriqAI 提出的“Agentic Economy”这个概念,感觉是真的想把 DeFi 底层做彻底改造。他们做的 Alpha Protocol,不只是给某类用户服务,而是想搭一整套多方协作的金融操作系统。

他们的切入点也挺聪明——现在项目发币之后,经常不知道怎么和 DeFi 结合,用 Alpha Protocol 就可以直接引入新型金融玩法,比如流动性策略、协议间的智能配合、甚至是多智能体之间的跨协议协作,等于是把“有币但不知道怎么玩”的项目引进一个完整生态。

对于那些做 DeFi 工具或者市场信号分析的项目,也有空间。他们可以把自己的数据或模型接入 Theoriq 网络,提供信号、提高 agent 表现,同时还能变现。这种“边用边赚”的机制,会吸引不少专业服务商入场。

更关键的是,对于资金方来说,不管是机构还是个体投资者,都可以用 Theoriq 的“swarm”系统来自动执行策略。特别在市场行情变动快的时候,全自动调仓、控制风险、抓机会,这种能力就很值钱。

最后,Theoriq 也没忘开发者。如果你能开发一个收益策略的 agent,不但可以上链运行、还可以通过表现获得收益激励。这种开放系统,搞不好会激发出一批新的智能体创业者。

整体看下来,Theoriq 这个体系像是要重构整个 DeFi 的逻辑。不是做一个协议,而是创造一套“智能体+协作+策略”的全链式生态。

他们的切入点也挺聪明——现在项目发币之后,经常不知道怎么和 DeFi 结合,用 Alpha Protocol 就可以直接引入新型金融玩法,比如流动性策略、协议间的智能配合、甚至是多智能体之间的跨协议协作,等于是把“有币但不知道怎么玩”的项目引进一个完整生态。

对于那些做 DeFi 工具或者市场信号分析的项目,也有空间。他们可以把自己的数据或模型接入 Theoriq 网络,提供信号、提高 agent 表现,同时还能变现。这种“边用边赚”的机制,会吸引不少专业服务商入场。

更关键的是,对于资金方来说,不管是机构还是个体投资者,都可以用 Theoriq 的“swarm”系统来自动执行策略。特别在市场行情变动快的时候,全自动调仓、控制风险、抓机会,这种能力就很值钱。

最后,Theoriq 也没忘开发者。如果你能开发一个收益策略的 agent,不但可以上链运行、还可以通过表现获得收益激励。这种开放系统,搞不好会激发出一批新的智能体创业者。

整体看下来,Theoriq 这个体系像是要重构整个 DeFi 的逻辑。不是做一个协议,而是创造一套“智能体+协作+策略”的全链式生态。

- 赞赏

- 点赞

- 评论

- 分享

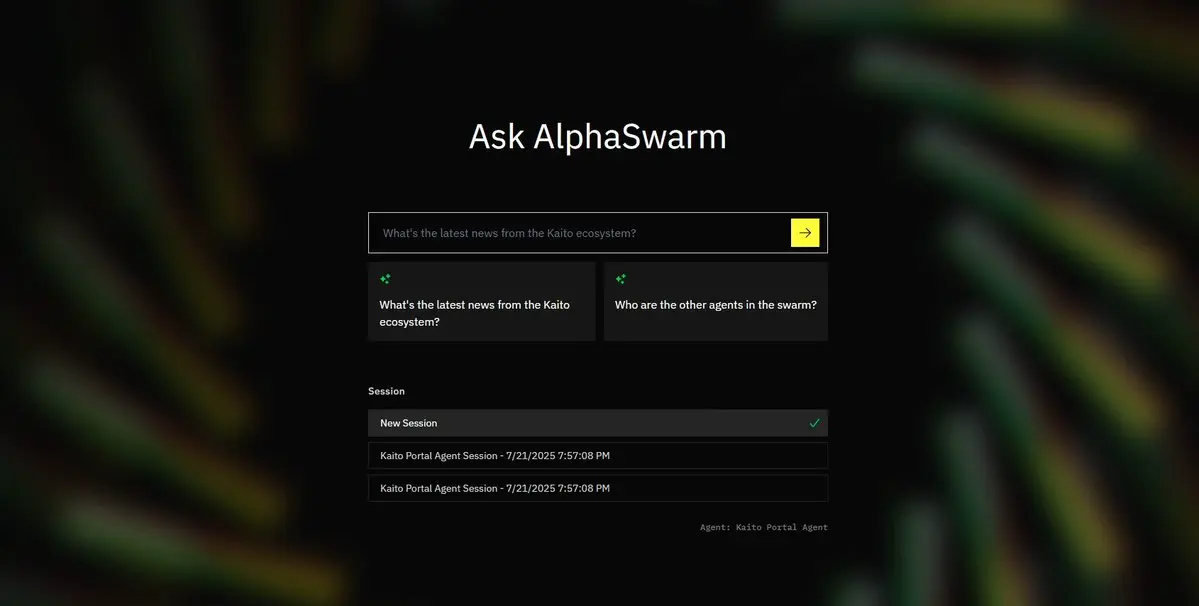

😜 @TheoriqAI 最近的进展节奏是真的快,主网已经在路上了,接下来关键的一步是 AlphaVaults 的上线。这一块其实就是把资金交给 AI agent 管理,而且是规模化地自动操作。

第一波接入,会和 Arrakis 合作,把 Uniswap v4 的支持集成进来,也算是正式开启 AlphaSwarm 的实战阶段。

从现在到 2025 年 Q3 主网上线,核心方向已经很清晰:SDK 放出、金库上线、收益策略集成,以及更多第三方 agent 的接入。每一步其实都在铺一条路,让资金管理这件事慢慢从“人做”变成“AI 自动跑”,而且更精准、更高效。

早期那种纯手动撸 DeFi 的玩法肯定是有价值的,但更像是打基础。真正的终点应该是链上的 agent 自动做决策、自动调仓、自动复投,普通用户只需要设定目标,就能实现财富管理。

Theoriq 想做的事情,说白了就是给这些“AI 管理资金”的未来打基础设施。他们不是等着趋势来了再跟风,而是直接上手把轨道铺出来。如果你对 agent 这个方向感兴趣,后面这波主网上线的进展值得重点盯住。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Aptos @0xPolygon @shoutdotfun $ENERGY 热度也很高

第一波接入,会和 Arrakis 合作,把 Uniswap v4 的支持集成进来,也算是正式开启 AlphaSwarm 的实战阶段。

从现在到 2025 年 Q3 主网上线,核心方向已经很清晰:SDK 放出、金库上线、收益策略集成,以及更多第三方 agent 的接入。每一步其实都在铺一条路,让资金管理这件事慢慢从“人做”变成“AI 自动跑”,而且更精准、更高效。

早期那种纯手动撸 DeFi 的玩法肯定是有价值的,但更像是打基础。真正的终点应该是链上的 agent 自动做决策、自动调仓、自动复投,普通用户只需要设定目标,就能实现财富管理。

Theoriq 想做的事情,说白了就是给这些“AI 管理资金”的未来打基础设施。他们不是等着趋势来了再跟风,而是直接上手把轨道铺出来。如果你对 agent 这个方向感兴趣,后面这波主网上线的进展值得重点盯住。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Aptos @0xPolygon @shoutdotfun $ENERGY 热度也很高

- 赞赏

- 点赞

- 评论

- 分享

😜 @Aptos 这波 RWA 做得是真有声有色,已经不只是“未来有潜力”了,而是实打实地把传统金融资产搬上链了。现在链上已经上线了十几种 RWA 产品,背后不光有 Web3 项目,也有像 BlackRock 和 Franklin Templeton 这种传统金融巨头直接参与。

PACT Protocol 是里头比较核心的项目,主打就是链上发债、发贷款那一套,现在链上的资产规模已经超过 3 亿美金了,最近又刚加了 8000 万。可以理解为把传统金融里的一整套贷款、打包、发证券的流程,都搬到了 Aptos 上。

更有意思的是,那些你以为不可能和 crypto 有交集的机构,也真的来了。比如 BlackRock 发的 BUIDL 是全球资产规模最大的链上基金,Franklin Templeton 的 BENJI 不仅规模大,而且直接用区块链来处理交易,这种根本就是打通了链下链上的数据流动。

另外像 Libre、Ondo 这种项目,也在补充更多细分的需求,比如稳定收益的美元资产、私募债、货币基金等。这些不是靠空投吸人,而是真有人想要用,背后代表的是一批合规的钱在往链上靠。

说到底,这不是哪家项目涨不涨的问题,而是 Aptos 在用一套更强的技术底座,把整个链上的金融资产生态做大。后面 RWA 的机会,可能不在叙事本身,而是谁能把这些资产打包成新的玩法,让传统的钱也愿意留下来。

关键是

PACT Protocol 是里头比较核心的项目,主打就是链上发债、发贷款那一套,现在链上的资产规模已经超过 3 亿美金了,最近又刚加了 8000 万。可以理解为把传统金融里的一整套贷款、打包、发证券的流程,都搬到了 Aptos 上。

更有意思的是,那些你以为不可能和 crypto 有交集的机构,也真的来了。比如 BlackRock 发的 BUIDL 是全球资产规模最大的链上基金,Franklin Templeton 的 BENJI 不仅规模大,而且直接用区块链来处理交易,这种根本就是打通了链下链上的数据流动。

另外像 Libre、Ondo 这种项目,也在补充更多细分的需求,比如稳定收益的美元资产、私募债、货币基金等。这些不是靠空投吸人,而是真有人想要用,背后代表的是一批合规的钱在往链上靠。

说到底,这不是哪家项目涨不涨的问题,而是 Aptos 在用一套更强的技术底座,把整个链上的金融资产生态做大。后面 RWA 的机会,可能不在叙事本身,而是谁能把这些资产打包成新的玩法,让传统的钱也愿意留下来。

关键是

- 赞赏

- 点赞

- 评论

- 分享

🧐 @burnt_xion 最近在韩国财经电视上高调亮相,背后其实透露了一个更大的战略意图——全面进军 APAC 市场。

创始人 Burnt Banksy 明确讲了,这次不是简单地做市场推广,而是开启一场多月的 APAC 行动计划。从他在美股圈的活跃,到现在将重心转向亚洲,说明 XION 真的是想借亚太这片土壤,把“让加密消失”这个理念落地为现实。

其实也不难理解。APAC 早就是新技术的试验场,从三星、现代,到中国的基建和数字支付,这里的用户本身就更容易接受前沿科技。而在 Web3 领域,这里更是占了全球用户的三分之二,有些国家加密持有率高达四分之一。

XION 想把 Web3 做到“像 Web2 一样简单”,那一定要从用户习惯和文化出发。亚洲正好具备这种兼容性,既拥抱新科技,又追求实际应用价值,这和 XION 的理念很对路。

现在他们不仅想吸引用户,更要吸引品牌、开发者和内容创作者,一起把生态做大。APAC 这场牌打得好,XION 不只是出海,而是有机会真正引爆全球 Web3 的下一波浪潮。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Aptos @0xPolygon @shoutdotfun $ENERGY 热度也很高

创始人 Burnt Banksy 明确讲了,这次不是简单地做市场推广,而是开启一场多月的 APAC 行动计划。从他在美股圈的活跃,到现在将重心转向亚洲,说明 XION 真的是想借亚太这片土壤,把“让加密消失”这个理念落地为现实。

其实也不难理解。APAC 早就是新技术的试验场,从三星、现代,到中国的基建和数字支付,这里的用户本身就更容易接受前沿科技。而在 Web3 领域,这里更是占了全球用户的三分之二,有些国家加密持有率高达四分之一。

XION 想把 Web3 做到“像 Web2 一样简单”,那一定要从用户习惯和文化出发。亚洲正好具备这种兼容性,既拥抱新科技,又追求实际应用价值,这和 XION 的理念很对路。

现在他们不仅想吸引用户,更要吸引品牌、开发者和内容创作者,一起把生态做大。APAC 这场牌打得好,XION 不只是出海,而是有机会真正引爆全球 Web3 的下一波浪潮。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Aptos @0xPolygon @shoutdotfun $ENERGY 热度也很高

- 赞赏

- 点赞

- 评论

- 分享

🫡 @TheoriqAI 在 @KaitoAI 的 Capital Launchpad 上开启了社区轮,提前放出了 $THQ 的认购机会。这轮是 Pre-TGE 阶段,算是官方第一次面向用户放出代币通道,而且是 7500 万估值、TGE 全解锁,超募了40倍,热度直接拉满了!!!

这次筹划得很细,整个流程分成三步,先是“预留额度”,再是“优先认购”,最后还有“先到先得”。第一阶段你要先锁个定金,表明你想认多少;第二阶段官方会发邮件告诉你有没有拿到;第三阶段是拼手速,没抢到额度的用户可以去捡漏。

对大部分人来说,关键是这次参与门槛还不高,在 Base 链上用 USDC pledge 就行,操作也不复杂。这轮还附带了一个额外福利——只要参与了就能提前用上 AlphaSwarm 的 Beta 版本,也算是提前体验 Theoriq 的核心产品。

其实从 Theoriq 之前一系列布局来看,他们做 Agentic Economy 是有章法的,这次融资节奏也挺克制,没有漫天要价、也不锁仓,说明项目方还是希望社区真能参与进来,而不是只搞一波短期拉升。

如果你本来就对 AI+DeFi 这个方向感兴趣,现在这个社区轮可能是一个不错的切入点,抢个资格,边体验 AlphaSwarm 边观察项目推进节奏,挺合适的。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Apto

这次筹划得很细,整个流程分成三步,先是“预留额度”,再是“优先认购”,最后还有“先到先得”。第一阶段你要先锁个定金,表明你想认多少;第二阶段官方会发邮件告诉你有没有拿到;第三阶段是拼手速,没抢到额度的用户可以去捡漏。

对大部分人来说,关键是这次参与门槛还不高,在 Base 链上用 USDC pledge 就行,操作也不复杂。这轮还附带了一个额外福利——只要参与了就能提前用上 AlphaSwarm 的 Beta 版本,也算是提前体验 Theoriq 的核心产品。

其实从 Theoriq 之前一系列布局来看,他们做 Agentic Economy 是有章法的,这次融资节奏也挺克制,没有漫天要价、也不锁仓,说明项目方还是希望社区真能参与进来,而不是只搞一波短期拉升。

如果你本来就对 AI+DeFi 这个方向感兴趣,现在这个社区轮可能是一个不错的切入点,抢个资格,边体验 AlphaSwarm 边观察项目推进节奏,挺合适的。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @Apto

- 赞赏

- 点赞

- 评论

- 分享

🫡 @Mira_Network 想换个思路来破局——与其让AI自己说了算,不如搞一个系统,站在AI的“上层”,专门负责验证AI说的到底对不对。现在大家都在说AI有多牛,但真正能落地的场景其实很有限。

说到底,AI目前最大的问题就是“不靠谱”——它能写出看起来很有逻辑的内容,但你一细看,就发现里面经常掺着假的。这种问题在聊天机器人里还好,但一旦要应用到医疗、法律、金融这种高风险场景,就完全不行了。

AI为什么会这样?一个核心原因是,它在“准确率”和“稳定性”之间总是无法兼顾。你想让它输出得更稳定,就要把训练数据收得更干净,结果就容易引入偏见。反过来你想让它更贴近真实世界、覆盖更全面,就得放进很多冲突的信息,模型反而变得“说话不靠谱”,也就是容易幻觉。

这种方式有点像给AI装一个“事实审核员”。AI先输出内容,Mira再把这些内容拆解成一段段小的判断,然后交给多个独立模型来验证,看这些结论是不是靠谱。多个模型达成共识后,再通过链上节点生成一个验证报告,相当于打上“已查证”的标记。

这个方向很有意思,因为它不是去改AI的“脑子”,而是给AI配了一个“监督系统”。如果这个系统真的跑得顺,以后我们可能就能放心让AI去做更复杂、更高风险的事情,比如自动写合同、自动审代码,甚至独立决策。这才是真正的AI基础设施。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @A

说到底,AI目前最大的问题就是“不靠谱”——它能写出看起来很有逻辑的内容,但你一细看,就发现里面经常掺着假的。这种问题在聊天机器人里还好,但一旦要应用到医疗、法律、金融这种高风险场景,就完全不行了。

AI为什么会这样?一个核心原因是,它在“准确率”和“稳定性”之间总是无法兼顾。你想让它输出得更稳定,就要把训练数据收得更干净,结果就容易引入偏见。反过来你想让它更贴近真实世界、覆盖更全面,就得放进很多冲突的信息,模型反而变得“说话不靠谱”,也就是容易幻觉。

这种方式有点像给AI装一个“事实审核员”。AI先输出内容,Mira再把这些内容拆解成一段段小的判断,然后交给多个独立模型来验证,看这些结论是不是靠谱。多个模型达成共识后,再通过链上节点生成一个验证报告,相当于打上“已查证”的标记。

这个方向很有意思,因为它不是去改AI的“脑子”,而是给AI配了一个“监督系统”。如果这个系统真的跑得顺,以后我们可能就能放心让AI去做更复杂、更高风险的事情,比如自动写合同、自动审代码,甚至独立决策。这才是真正的AI基础设施。

关键是它在 @KaitoAI 上有榜单活动, 最近 @arbitrum @A

- 赞赏

- 点赞

- 评论

- 分享