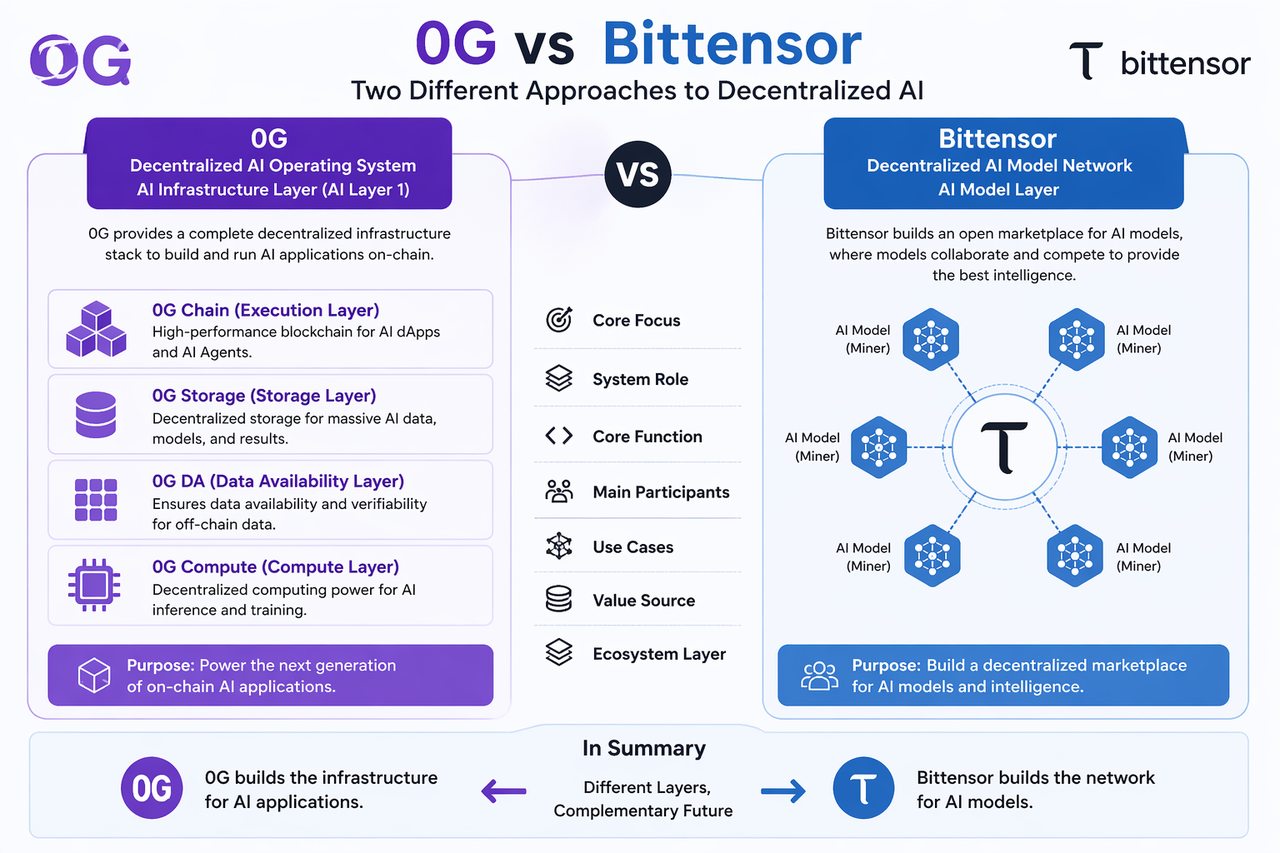

0G vs Bittensor: principais diferenças entre infraestrutura de IA descentralizada e redes de modelos de IA

Com a integração entre IA e blockchain avançando rapidamente, a IA descentralizada segue dois rumos bem definidos: um voltado para a construção de redes colaborativas em torno dos próprios modelos de IA, e outro dedicado ao desenvolvimento da infraestrutura essencial para aplicações de IA.

Bittensor e 0G são exemplos claros dessas abordagens. Bittensor possibilita a colaboração global de modelos de IA por meio de incentivos, enquanto a 0G oferece ambientes de alto desempenho e escaláveis para aplicações de IA. Essa distinção estratégica define o papel de cada uma no ecossistema.

0G e Bittensor: posicionamento no ecossistema de IA

0G e Bittensor atuam em camadas distintas dentro do ecossistema de IA.

A 0G ocupa a camada de infraestrutura (Camada de Infraestrutura de IA), fornecendo ambientes operacionais para aplicações de IA, incluindo computação, armazenamento e disponibilidade de dados. Seu objetivo é ser a AI Layer1, permitindo que Agentes de IA operem de forma eficiente on-chain.

Já a Bittensor opera na camada de protocolo, conectando provedores de modelos de IA e validadores por meio de incentivos, criando um mercado descentralizado de modelos de IA.

Em resumo, a 0G foca na “execução da IA”, enquanto a Bittensor prioriza a “conexão da IA”.

Comparação central: 0G vs Bittensor

Do ponto de vista da arquitetura de sistemas, a principal diferença entre elas está na camada de infraestrutura.

| Dimensão de comparação | 0G | Bittensor |

|---|---|---|

| Posicionamento central | Infraestrutura de IA descentralizada (AI Layer1) | Rede descentralizada de modelos de IA |

| Objetivo principal | Fornecer ambientes operacionais para dApps de IA e Agentes de IA | Construir uma rede aberta de colaboração e incentivos para modelos de IA |

| Papel no sistema | Camada de infraestrutura para aplicações de IA | Camada de rede de modelos e inferência de IA |

| Arquitetura técnica | Modular: Chain, Storage, DA, Compute | Rede de machine learning orientada por subnets |

| Capacidades principais | Execução, armazenamento, disponibilidade de dados, computação descentralizada | Treinamento de modelos de IA, inferência e incentivos por contribuição |

| Público-alvo | Desenvolvedores de IA e criadores de aplicações | Provedores de modelos de IA e pesquisadores |

| Cenários de aplicação | Agentes de IA, aplicações de IA on-chain, dApps de IA | Serviços de inferência descentralizada, mercados de modelos |

| Fonte de valor | Uso da infraestrutura e demanda por aplicações de IA | Contribuições de modelos e recompensas pela qualidade da inferência |

| Nível no ecossistema | Camada de Infraestrutura de IA (Infra Layer) | Camada de Rede de Modelos de IA (Model Layer) |

| Posicionamento relacional | Suporte para aplicações de IA | Rede de fornecimento de inteligência de IA |

A 0G é uma rede modular AI Layer1, composta por camadas de execução (Chain), armazenamento (Storage), disponibilidade de dados (DA) e computação (Compute), todas projetadas para suportar cargas de trabalho de IA.

A Bittensor, por outro lado, é baseada em mecanismos de incentivo, tendo a estrutura de rede de subnets como núcleo, orquestrando a contribuição e distribuição de recompensas entre diferentes modelos de IA — formando um verdadeiro “sistema econômico de modelos de IA”.

0G: a rede de infraestrutura AI Layer1

A 0G foi desenvolvida para entregar uma pilha de infraestrutura de IA completa, permitindo que aplicações de IA rodem nativamente on-chain.

Sua arquitetura de quatro camadas suporta Agentes de IA e aplicações de IA on-chain, composta por:

- Camada de execução para processamento lógico

- Camada de armazenamento para persistência de dados

- Camada DA para validação de dados

- Camada de computação para poder de hash descentralizado

Assim, a 0G funciona como um “sistema operacional de IA”, priorizando capacidade computacional e integridade da infraestrutura.

Bittensor: rede descentralizada de modelos de IA

O principal objetivo da Bittensor é criar uma rede aberta de modelos de IA, estimulando competição e colaboração entre modelos por meio de incentivos.

Nesse sistema, diferentes modelos atuam como nós, participando da rede e recebendo recompensas conforme a qualidade de suas contribuições. Essa estrutura se assemelha mais a um Mercado de Modelos de IA do que a uma camada de infraestrutura.

Com isso, a Bittensor está voltada para a “produção e distribuição de inteligência de IA”, em vez do “ambiente operacional para IA”.

Diferenças de cenários de aplicação: 0G vs Bittensor

A 0G é ideal para aplicações de IA on-chain que exigem alta capacidade de computação e armazenamento, como Agentes de IA, sistemas autônomos de execução e tarefas complexas de inferência.

A Bittensor, por sua vez, é mais indicada para treinamento de modelos de IA, compartilhamento de modelos e colaboração de inteligência distribuída — como mercados de modelos e redes de serviços de inferência.

As duas não competem diretamente na camada de aplicação, mas ocupam posições distintas na stack de IA.

Comparação de papéis no ecossistema: 0G vs Bittensor

No ecossistema de IA descentralizada, a Bittensor atua principalmente na camada de modelos, fornecendo inteligência de IA, enquanto a 0G oferece a camada de infraestrutura, com computação, armazenamento e ambientes de execução.

Com o amadurecimento do ecossistema de IA, esses sistemas tendem a se complementar: redes de modelos fornecem inteligência, a infraestrutura garante a base operacional e, juntas, viabilizam ecossistemas de aplicações de IA cada vez mais sofisticados.

Resumo

0G e Bittensor representam caminhos distintos no desenvolvimento de IA descentralizada. A Bittensor foca em redes de modelos de IA, construindo um mercado aberto de machine learning via incentivos; a 0G se dedica à infraestrutura de IA, oferecendo um ambiente on-chain completo para aplicações de IA.

Elas não concorrem diretamente, pois cada uma atua em uma camada diferente do ecossistema de IA. Com o crescimento das aplicações de IA, redes de modelos e infraestrutura tendem a trabalhar de forma integrada, impulsionando o avanço do ecossistema de IA descentralizada.

Perguntas frequentes

Qual é a principal diferença entre 0G e Bittensor?

A 0G é uma AI Infrastructure Layer1 que oferece computação e armazenamento; a Bittensor é uma rede de modelos de IA focada em colaboração entre modelos e distribuição de incentivos.

A qual camada a 0G pertence na arquitetura de IA?

A 0G faz parte da AI Infrastructure Layer, especializada em ambientes operacionais de IA on-chain e infraestrutura computacional.

Qual é o mecanismo central da Bittensor?

A Bittensor conecta nós de modelos de IA por meio de incentivos, permitindo que modelos compitam e recebam recompensas na rede.

0G e Bittensor podem operar juntas?

Sim, elas atuam em camadas diferentes da stack de IA — uma fornece infraestrutura, a outra entrega a rede de modelos.

Qual é mais orientada à infraestrutura?

A 0G é mais orientada à infraestrutura (AI Layer1), enquanto a Bittensor é mais voltada à rede de aplicações (AI Model Layer).

Artigos Relacionados

Morpho vs Aave: Análise comparativa dos mecanismos e diferenças estruturais nos protocolos de empréstimo DeFi

Tokenomics da Morpho: utilidade do MORPHO, distribuição e proposta de valor

O que é o EIP-1559? Como funcionam o burning de ETH e o mecanismo de taxas?

O que é a Carteira HOT no Telegram?

O que é Bitcoin?