¿La suscripción a la versión Pro ya no permite usar Claude Code? La prueba limitada de Anthropic genera controversia

Título original: Anthropic prueba cómo reaccionan los desarrolladores al retirar Claude Code del plan Pro

Autor original: Thomas Claburn, The Register

Traducción: Peggy, BlockBeats

Prólogo del editor: Recientemente, un cambio en la página de precios oficial de Anthropic ha generado una amplia atención en la comunidad de desarrolladores: Claude Code, que originalmente estaba incluido en la suscripción Pro, desapareció repentinamente, y algunas páginas incluso marcaron esta función con una «X» indicando que ya no estaba incluida. Aunque la compañía posteriormente afirmó que esto era solo una prueba a pequeña escala para aproximadamente el 2% de los nuevos usuarios, y que los suscriptores existentes no se verían afectados, debido a que la información no se sincronizó en todas las páginas y a la discrepancia entre la atención al cliente y el estado real del producto, este cambio fue rápidamente interpretado como una señal de «restringir derechos».

Desde el punto de vista del evento en sí, esto parece más una pérdida de comunicación que ha provocado una fluctuación en la confianza; pero en un contexto más amplio de la industria, refleja una transformación estructural que los productos de IA están atravesando. Como explicó Amol Avasare, el uso de Claude por parte de los usuarios ha pasado de simples conversaciones a generación de código, desarrollo colaborativo e incluso flujos de trabajo de agentes de larga duración, lo que ha incrementado significativamente el consumo de recursos por usuario. Y el sistema de suscripción actual, basado en la «utilización ligera», no puede cubrir los crecientes costos de computación.

Esto también explica por qué Anthropic ha estado introduciendo restricciones de uso con frecuencia y explorando nuevas estructuras de planes: mientras las capacidades del modelo continúan mejorando y el ecosistema de desarrolladores se expande (como en proyectos como OpenClaw), la plataforma debe volver a equilibrar la «asequibilidad» y la «sostenibilidad». Esta presión no es exclusiva; Google, GitHub y otros también enfrentan problemas similares.

¿Cuando la IA pasa de ser una herramienta a convertirse en infraestructura de uso frecuente y intensivo, la lógica de suscripción original sigue siendo válida? ¿Y cómo redefinirá la plataforma la relación entre «pago» y experiencia del usuario, en medio de restricciones de costos?

A continuación, el texto original:

Anthropic ha eliminado Claude Code de su plan de suscripción Pro — al menos, así parece en algunas páginas públicas. Sin embargo, la compañía afirma que esto es solo una prueba a pequeña escala para algunos usuarios.

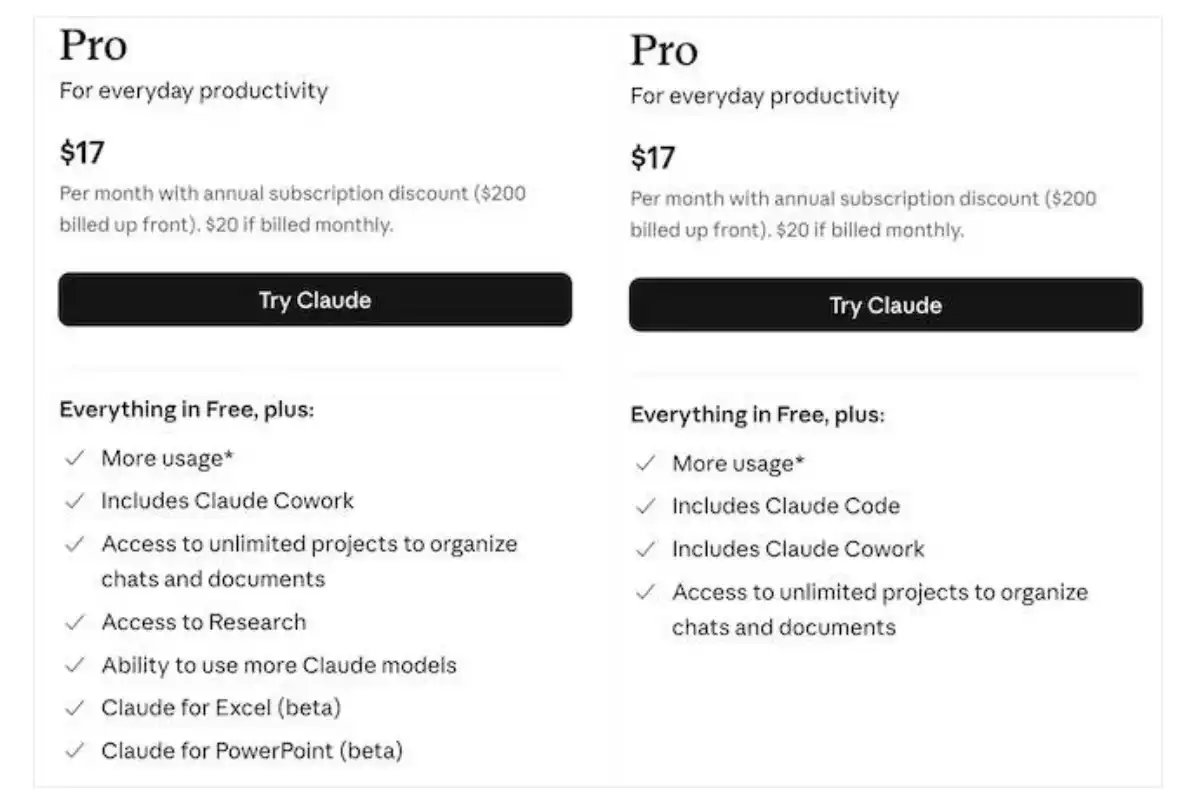

El lunes, la página de precios de la compañía aún indicaba que el plan Pro «incluía Claude Code»; pero para el martes, esa declaración había desaparecido, y en la misma lista de funciones, la opción de Claude Code pasó de estar marcada con una marca de verificación a una «X» clara. Este cambio fue señalado inicialmente por el escéptico de la industria de IA, Ed Zitron.

Sin embargo, esta modificación del producto aún no se ha sincronizado en todas las páginas de Anthropic. Hasta el momento de la publicación, la página del producto Claude Code seguía mostrando que el plan Pro podía usar esa herramienta de generación de código. Y cuando este periodista accedió a Claude Code mediante la interfaz de línea de comandos (CLI), la salida del terminal seguía mostrando «Claude Pro».

Captura de pantalla de la información de suscripción a Claude Code en la página de Anthropic

Al consultarle sobre esto, Claude.ai afirmó que el plan Pro incluye Claude Code, pero en una página de documentación actualizada hoy solo se menciona el plan Max.

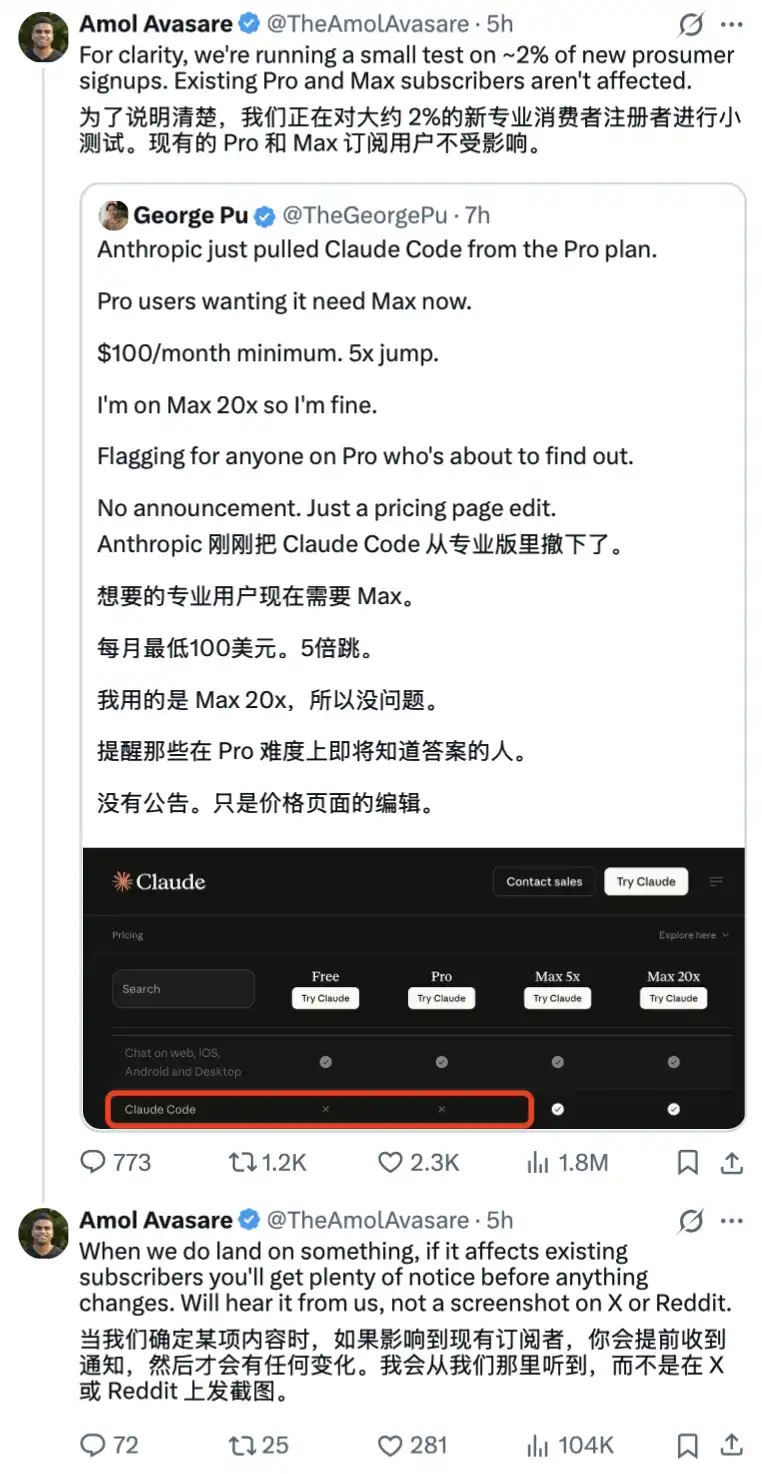

La pérdida de acceso a Claude Code claramente ha generado inquietud entre muchos desarrolladores, y esta sensación también llegó a Anthropic. El responsable de crecimiento de la compañía, Amol Avasare, publicó en redes sociales que este cambio en realidad era un experimento.

Él dijo: «Para aclarar, estamos realizando una prueba a pequeña escala en aproximadamente el 2% de los nuevos usuarios registrados en Pro (orientados a usuarios profesionales). Los suscriptores existentes de Pro y Max no se verán afectados.»

Sobre por qué Anthropic cree que la actualización en su página de precios solo afectará a algunos usuarios y no a toda Internet, no está claro. Tampoco la compañía ha respondido a preguntas de seguimiento sobre este asunto.

Avasare explicó además: «Cuando lanzamos Max hace un año, no incluía Claude Code, Cowork aún no existía, y los agentes que podían funcionar durante horas continuas todavía no estaban disponibles. El objetivo de Max en ese momento era simple: satisfacer el uso intensivo de chat. Pero desde entonces, hemos integrado Claude Code en Max, y tras el lanzamiento de Opus 4, se volvió muy popular. Cowork se lanzó, y los agentes asincrónicos de larga duración se convirtieron en parte del flujo de trabajo diario. La forma en que los usuarios utilizan Claude ha cambiado radicalmente. La intensidad de uso por suscriptor ha aumentado notablemente. Hemos hecho algunos ajustes menores (como límites semanales y restricciones en horas punta), pero el patrón de uso en general ha cambiado mucho, y los planes existentes no estaban diseñados para esto. Por eso, estamos explorando diferentes opciones para seguir ofreciendo una buena experiencia. La forma exacta aún no está definida — esto es precisamente lo que estamos probando y recopilando retroalimentación.»

Recientemente, Anthropic ha estado tomando medidas para limitar el uso de sus modelos de IA, con el fin de frenar la demanda en momentos de escasez de recursos, un problema que también enfrentan GitHub y Google. En los últimos meses, la serie Claude se ha popularizado rápidamente, y con la aparición de proyectos como OpenClaw, muchos desarrolladores han comenzado a construir diversos agentes basados en Claude.

El problema central es que la suscripción de Anthropic cuesta mucho menos que el costo real en tokens, a veces incluso por un orden de magnitud. El mes pasado, la compañía introdujo restricciones de uso para incentivar a los usuarios a usar el servicio en horas no punta, similar a cómo las compañías eléctricas fomentan el ahorro energético mediante tarifas diferenciadas. Como dijo Avasare, Anthropic sigue explorando más restricciones de uso.

No sorprende que muchos usuarios de Claude hayan expresado su insatisfacción en foros. Muchos pensaban que esto era un ajuste sustancial en los planes, y señalaron que Anthropic parece estar «camuflando» una estrategia para impulsar a los usuarios de Pro a cambiar a modelos chinos más económicos, como Minimax, Qwen, Kimi y GLM.

Pero lo que llama más la atención no es tanto el cambio en sí, sino la falta de comunicación. Anthropic parece no haber explicado claramente la situación a los usuarios, como si considerara que los usuarios individuales que pagan 20 dólares al mes no necesitan ser informados con antelación.

Pero los clientes empresariales claramente no aceptarán esa incertidumbre, y podrían preocuparse de que Anthropic no priorice la relación con sus clientes.

Avasare parece haberse dado cuenta de esto. Él dijo: «Una vez que definamos la solución final, si implica cambios en los suscriptores existentes, los notificaremos con suficiente antelación.» Y prometió que los usuarios «lo sabrán directamente de nosotros, no por capturas en X o Reddit.»

Cabe aclarar que esta declaración en sí misma fue publicada por él en X.

[Enlace al original]

Haz clic para conocer las ofertas laborales de BlockBeats

Únete a la comunidad oficial de BlockBeats:

Grupo de suscripción en Telegram: https://t.me/theblockbeats

Grupo de Telegram: https://t.me/BlockBeats_App

Cuenta oficial en Twitter: https://twitter.com/BlockBeatsAsia

Artículos relacionados

Las empresas globales de hiperescala en la nube prevén que el capex de IA alcance los 1 billón en 2027, un 25% más interanual: BofA

PayPal revela una reorganización en tres unidades y apunta a $900M ahorros anuales para finales de 2027

Kaisar Network completa $4 millón en financiación para la capa 1 de computación de IA descentralizada

El CFO de OpenAI descarta los rumores sobre objetivos de ingresos y afirma que la empresa está ejecutando a su nivel más alto el 1 de mayo

El asesor de Musk revela la oferta de $974B de xAI para activos de la organización sin fines de lucro OpenAI en un tribunal, lo que eleva un nuevo nivel de escrutinio

Musk admite que xAI utilizó destilación en modelos de OpenAI durante el Día 4 del juicio