Anthropics dreifache Momente: Code-Lecks, Regierungs-Konfrontation und Militarisierung

Originaltitel: Anthropic: The Leak, The War, The Weapon

Originalautor: BuBBliK

Übersetzung: Peggy,BlockBeats

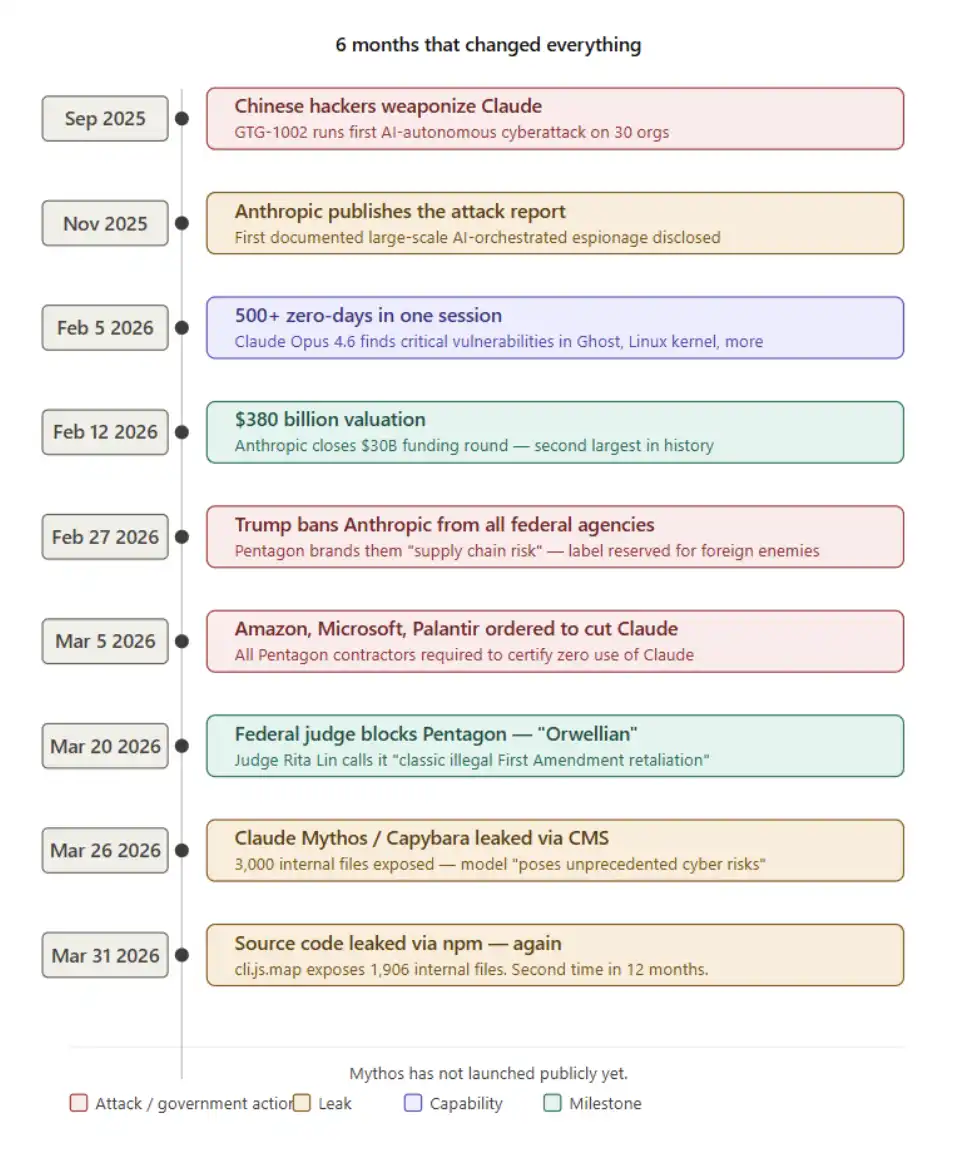

Redaktioneller Kommentar: In den vergangenen sechs Monaten geriet Anthropic wiederholt in eine Reihe von Vorfällen, die auf den ersten Blick unabhängig voneinander wirkten, in Wirklichkeit jedoch aufeinander verwiesen: ein Sprung in der Leistungsfähigkeit der Modelle, automatisierte Angriffe in der realen Welt, heftige Reaktionen der Kapitalmärkte, offene Konflikte mit der Regierung sowie mehrfaches Informationsleck, das durch Fehler in der grundlegenden Konfiguration verursacht wurde. Betrachtet man diese Hinweise gemeinsam, zeichnet sich daraus eine klarere Richtung des Wandels ab.

Der vorliegende Artikel nimmt genau diese Ereignisse als Ausgangspunkt, um den kontinuierlichen Verlauf eines KI-Unternehmens in den Bereichen technischer Durchbruch, Risikoexponierung und Governance-Dilemmata nachzuzeichnen – und versucht, eine tiefergehende Frage zu beantworten: Wenn die Fähigkeit „Schwachstellen zu entdecken“ massiv verstärkt und sich zudem schrittweise ausbreitet, kann das System der Cybersicherheit selbst dann noch seine ursprüngliche Funktionslogik aufrechterhalten?

Früher beruhte Sicherheit auf Ressourcenknappheit und menschlichen Grenzen; unter den neuen Bedingungen aber verläuft Angriff und Verteidigung zunehmend um dieselbe Modellfähigkeiten herum, und die Grenzen werden immer unschärfer. Gleichzeitig verbleiben die Reaktionen von Institutionen, Märkten und Organisationen noch in alten Rahmenwerken und können diese Veränderung kaum rechtzeitig aufnehmen.

Dieser Artikel betrachtet nicht nur Anthropic selbst, sondern eine größere Realität, die es widerspiegelt: KI verändert nicht nur Werkzeuge, sondern auch die Voraussetzungen dafür, wie „Sicherheit überhaupt zustande kommt“.

Im Folgenden der Originaltext:

Wenn ein Unternehmen mit einer Marktkapitalisierung von 380 Milliarden US-Dollar mit dem Pentagon im Streit liegt und die Oberhand behält, den ersten von einer autonomen KI initiierten Cyberangriff übersteht, und dann intern sogar ein Modell leakt, das selbst bei den eigenen Entwicklern Furcht auslöst, ja sogar „aus Versehen“ den vollständigen Quellcode veröffentlicht – wie würde das dann aussehen, wenn all das zusammenkommt?

Die Antwort ist: genau so, wie es jetzt ist. Und noch beunruhigender ist, dass der wirklich gefährliche Teil vielleicht noch gar nicht passiert ist.

Rückblick auf die Ereignisse

Anthropic leakt erneut seinen eigenen Code

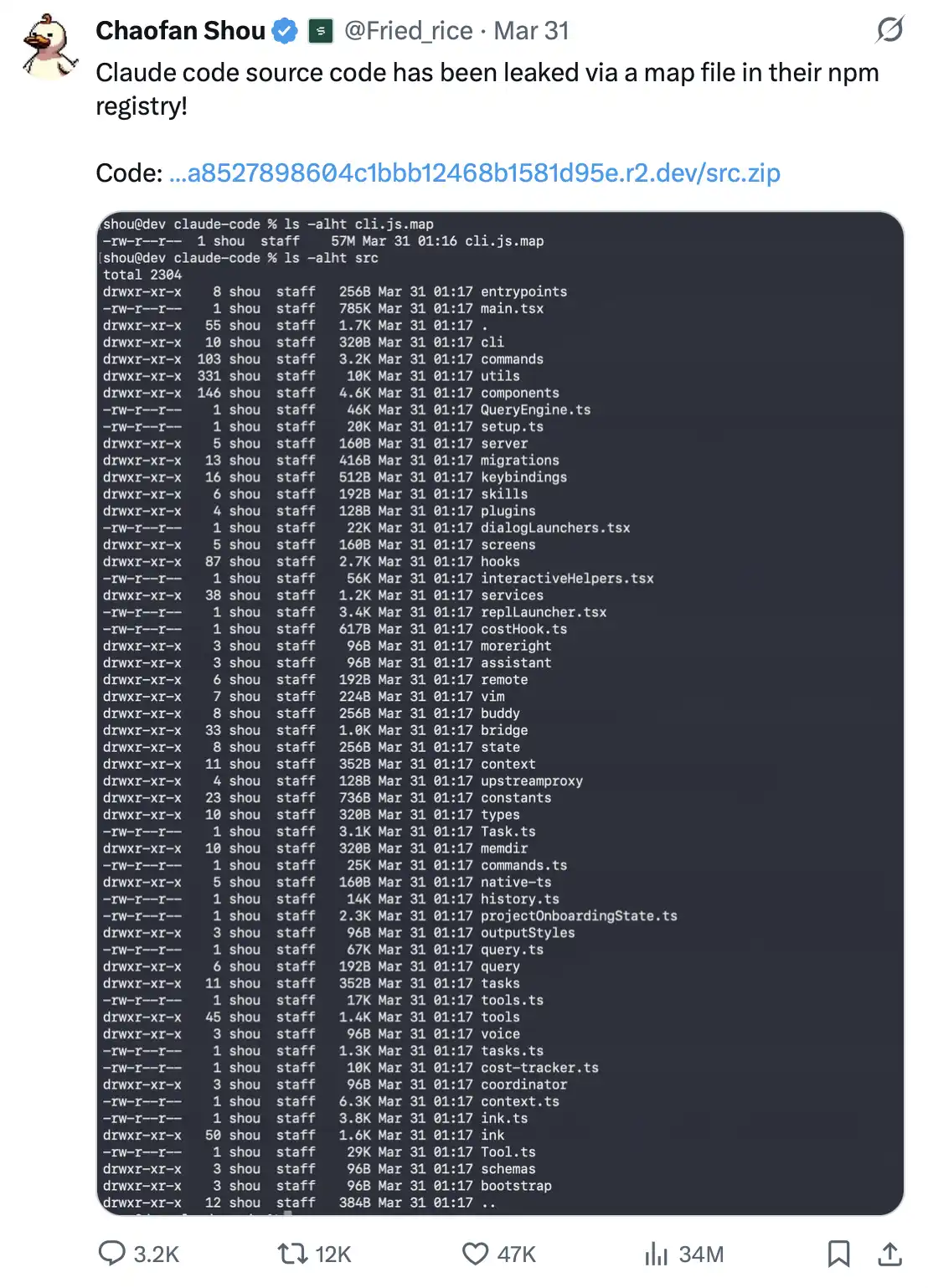

Am 31. März 2026 entdeckte der Sicherheitsforscher Shou Chaofan, der bei dem Blockchain-Unternehmen Fuzzland arbeitet, beim Prüfen des offiziell veröffentlichten Claude Code npm-Pakets, dass es sogar eine Datei namens cli.js.map in Klartext enthält.

Diese Datei hat eine Größe von 60 MB, und der Inhalt ist noch erstaunlicher. Sie enthält nahezu den gesamten vollständigen TypeScript-Quellcode des Produkts. Mit nur dieser einen Datei kann jeder bis zu 1906 interne Quellcode-Dateien rekonstruieren: darunter das Design interner APIs, das Telemetriesystem, kryptografische Tools, Sicherheitslogik, das Plugin-System – praktisch alle zentralen Bausteine sind damit offen einsehbar. Noch wichtiger: Diese Inhalte lassen sich sogar direkt als zip-Datei aus dem R2-Storage-Bucket von Anthropic herunterladen.

Die Entdeckung verbreitete sich schnell in den sozialen Medien: Innerhalb weniger Stunden verzeichneten die entsprechenden Beiträge 754k Aufrufe und fast 1000 Weiterleitungen; zugleich wurden mehrere GitHub-Repositories, in denen der Quellcode rekonstruiert wurde, umgehend erstellt und öffentlich gemacht.

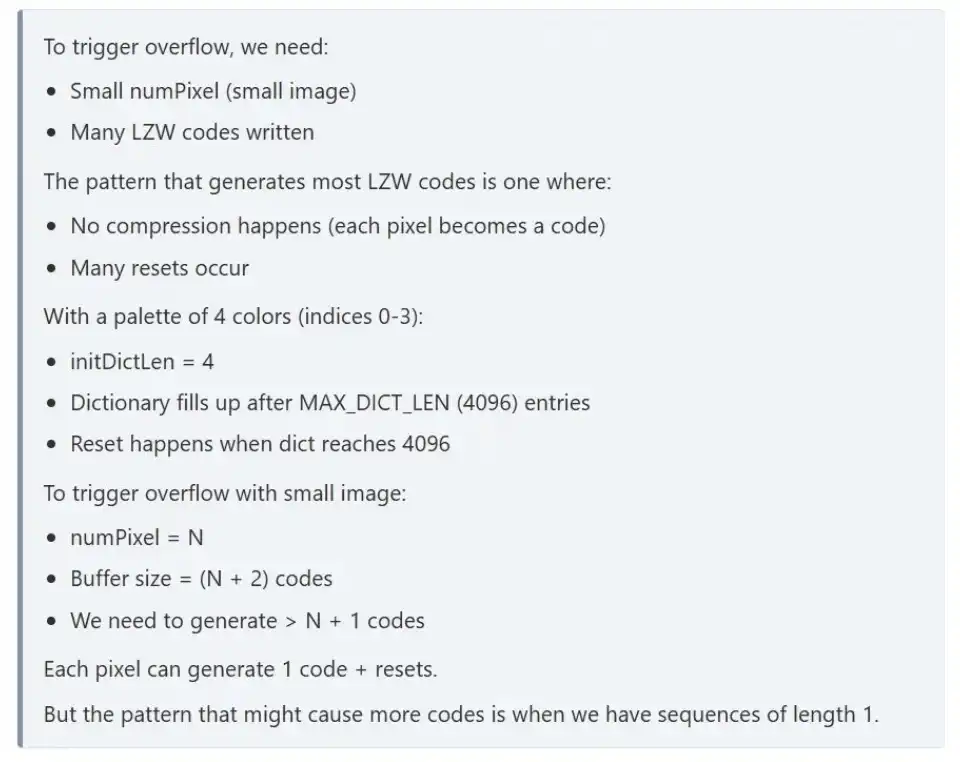

Was man „source map“ (Quellzuordnungsdatei) nennt, ist im Kern nur eine Hilfsdatei für das Debugging in JavaScript. Ihre Aufgabe besteht darin, komprimierten bzw. kompilierten Code zurück in den ursprünglichen Quellcode zu überführen – damit Entwickler Probleme schneller nachvollziehen und beheben können.

Dabei gibt es aber ein grundlegendes Prinzip: Sie sollte niemals in Veröffentlichungs-Paketen für die Produktion enthalten sein.

Das ist keine ausgeklügelte Angriffsmethode, sondern ein ganz grundlegendes Problem der Engineering-Vorschriften – „Build-Config-Grundlagen 101“, sogar etwas, das Entwickler in der ersten Woche lernen. Wenn source map fälschlicherweise in das Produktionsumfeld gepackt wird, entspricht sie in der Praxis oft dem „Beipacken“ des Quellcodes für alle.

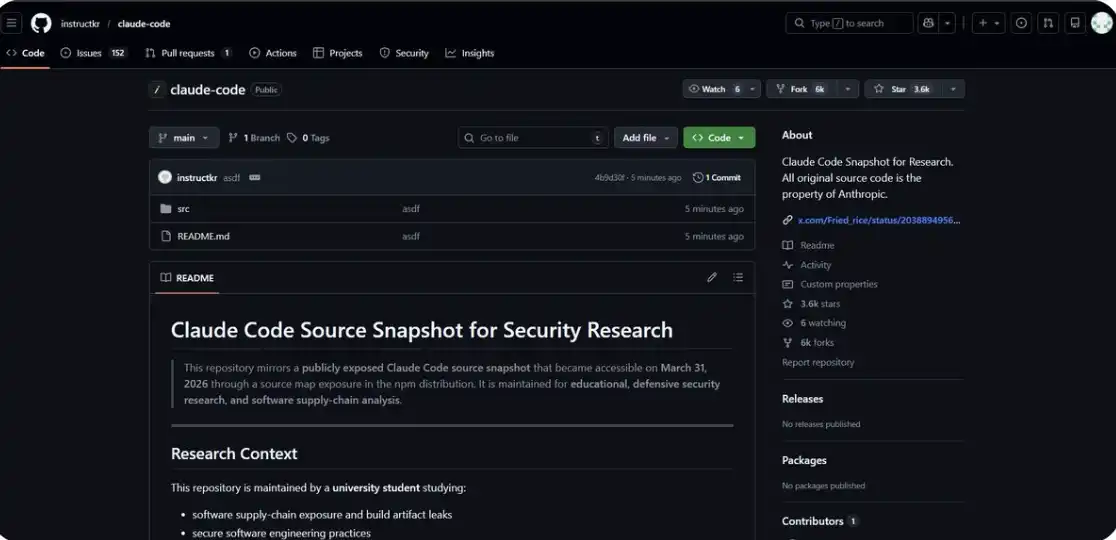

Du kannst dir die entsprechende Stelle auch hier direkt ansehen: https://github.com/instructkr/claude-code

Was jedoch wirklich absurd ist, liegt daran, dass das bereits einmal passiert ist.

Im Februar 2025 – also vor einem Jahr – gab es beinahe eine identische Leckage: dieselbe Datei, derselbe Fehler. Damals hatte Anthropic die alte Version von npm gelöscht, die source map entfernt und eine neue Version erneut veröffentlicht; damit war die Sache zunächst beruhigt.

Doch in Version v2.1.88 wurde diese Datei erneut wieder mit gepackt und veröffentlicht.

Ein Unternehmen mit einer Marktkapitalisierung von 380 Milliarden US-Dollar, das gerade weltweit eines der fortschrittlichsten Systeme zur Erkennung von Schwachstellen aufbaut, begeht innerhalb eines Jahres zweimal denselben grundlegenden Fehler. Kein Hackerangriff, kein komplexer Ausnutzungspfad – nur ein Build-Prozess, der eigentlich funktionieren sollte, ist schiefgelaufen.

Diese Ironie hat fast etwas „Poetisches“.

Jenes KI-System, das in einem einzigen Lauf 500 Zero-Day-Schwachstellen findet; jenes Modell, das dazu genutzt wurde, automatisierte Angriffe gegen 30 Institutionen weltweit zu starten – und gleichzeitig verschenkt Anthropic den eigenen Quellcode, direkt „mit dem Paket“, an jeden, der bereit ist, einen Blick in das npm-Paket zu werfen.

Zwei Lecks, nur durch sieben Tage getrennt.

Die Ursache jedoch ist dieselbe: ein grundlegendster Konfigurationsfehler. Es bedarf keiner technischen Hürden und keines komplexen Ausnutzungspfads. Solange man weiß, wo man nachschaut, kann es sich jeder kostenlos holen.

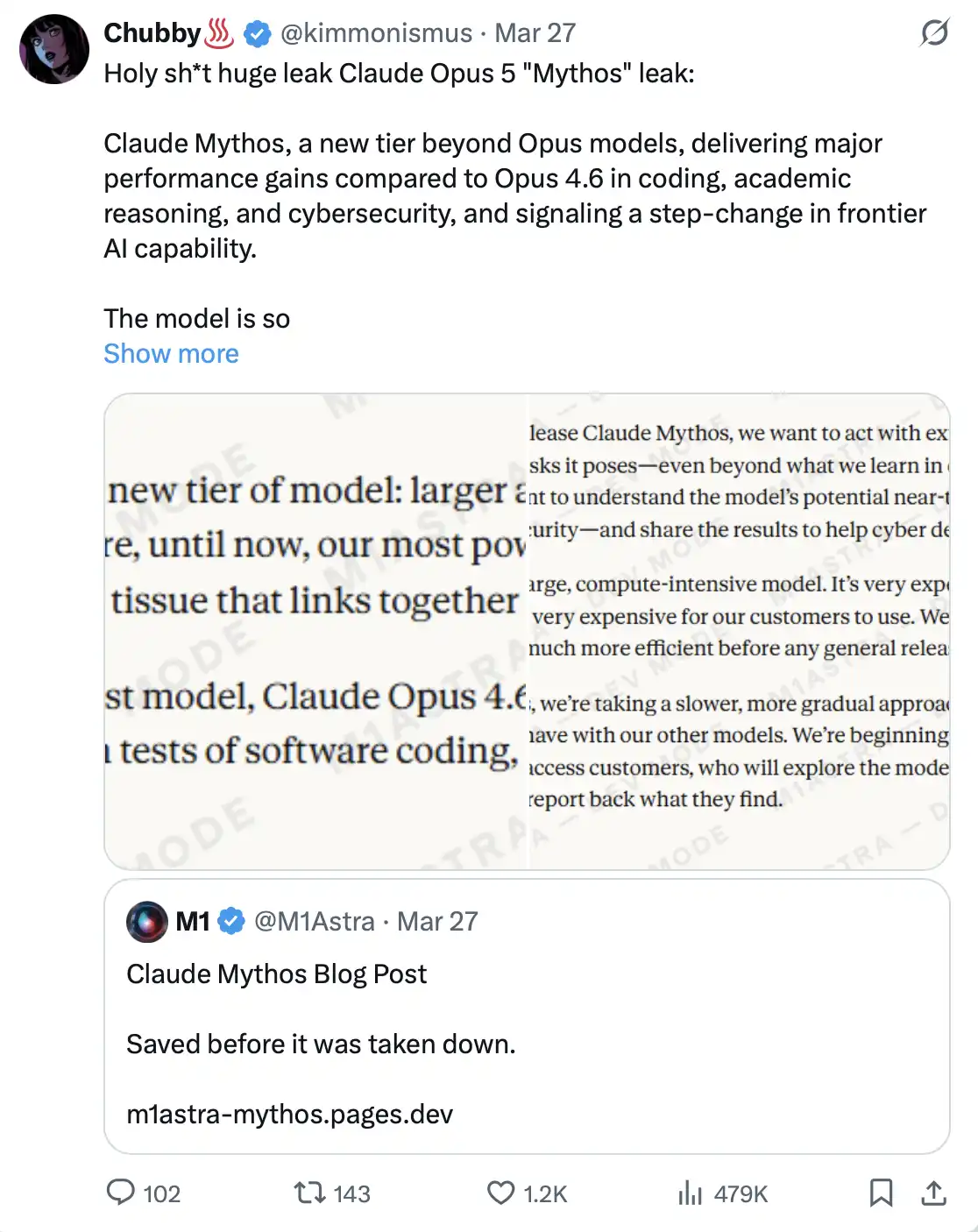

Vor einer Woche: Unbeabsichtigte Offenlegung interner „gefährlicher Modelle“

Am 26. März 2026 fanden die Sicherheitsforscher Roy Paz von LayerX Security sowie Alexandre Pauwels von der University of Cambridge ein Problem in der CMS-Konfiguration auf der offiziellen Website von Anthropic. Dadurch wurden etwa 3000 interne Dateien öffentlich zugänglich.

Zu diesen Dateien gehören: Entwürfe für Blogposts, PDFs, interne Dokumente und Präsentationsmaterial – alles offen zugreifbar in einem nicht geschützten, durchsuchbaren Datenspeicher. Kein Hackerangriff und kein Einsatz irgendeiner technischen Maßnahme nötig.

Unter diesen Dateien gab es zwei fast identische Blog-Entwürfe. Der einzige Unterschied war der Modellname: einer trug „Mythos“, der andere „Capybara“.

Das bedeutet, dass Anthropic damals zwischen zwei Namen für dasselbe geheime Projekt abwog. Das Unternehmen bestätigte anschließend: Das Training für dieses Modell sei abgeschlossen und es werde bereits an ausgewählte frühe Kunden getestet.

Das war keine übliche Routine-Upgrade für Opus, sondern ein ganz neues „Level-4“-Modell – eines, das sogar über Opus verortet ist.

In den eigenen Entwürfen von Anthropic wird es beschrieben als: „größer und intelligenter als unser Opus-Modell – und Opus ist bis heute nach wie vor unser stärkstes Modell.“ In Programmierfähigkeit, akademischem Schlussfolgern und auch in Netzwerksicherheit gelangten deutliche Sprünge. Ein Sprecher bezeichnete es als „einen qualitativen Sprung“, außerdem als „das stärkste Modell, das wir bisher gebaut haben“.

Doch das, worauf es wirklich ankommt, liegt nicht in diesen Leistungsbeschreibungen selbst.

In den geleakten Entwürfen bewertet Anthropic dieses Modell so: Es „bringt beispiellose Risiken für die Cybersicherheit“, es „übertrifft in seinen Fähigkeiten im Netzbereich jedes andere KI-Modell bei Weitem“ und es „kündigt eine Welle ankommender Modelle an – deren Fähigkeit, Schwachstellen auszunutzen, wird deutlich schneller sein als die Reaktionsgeschwindigkeit der Verteidiger“.

Mit anderen Worten: In einem noch nicht veröffentlichten offiziellen Blog-Entwurf hat Anthropic bereits ganz offen eine seltene Position eingenommen – sie fühlen sich unwohl mit dem Produkt, das sie gerade bauen.

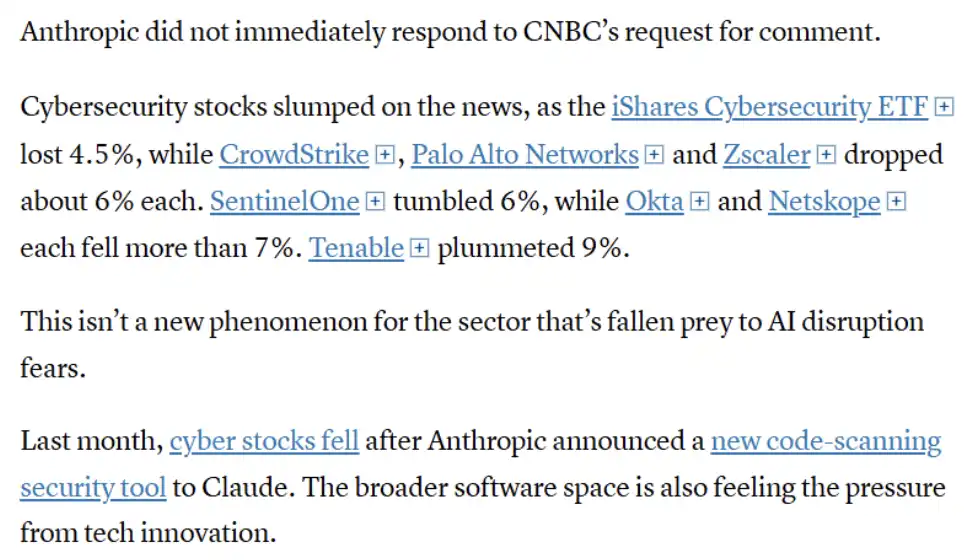

Die Reaktion des Marktes war praktisch sofort. Der Kurs von CrowdStrike fiel um 7%, Palo Alto Networks um 6%, Zscaler um 4,5%; Okta und SentinelOne verzeichneten beiderseits Rückgänge von mehr als 7%, Tenable sogar einen Absturz von 9%. Der iShares Cybersecurity ETF rutschte am selben Tag um 4,5% ab. Allein bei CrowdStrike verlor das Unternehmen noch am selben Tag rund 15 Milliarden US-Dollar an Marktkapitalisierung. Gleichzeitig fiel Bitcoin auf 66.000 US-Dollar zurück.

Der Markt hat dieses Ereignis offensichtlich als eine Art „Urteil“ über die gesamte Cybersicherheitsbranche interpretiert.

Sinngemäße Bildbeschreibung: Unter dem Einfluss der entsprechenden Meldungen fiel der gesamte Bereich Cybersicherheit insgesamt; mehrere führende Unternehmen (z. B. CrowdStrike, Palo Alto Networks, Zscaler usw.) zeigten deutliche Kursrückgänge. Das spiegelt die Sorge des Marktes über die Auswirkungen von KI auf die Cybersicherheitsbranche wider. Allerdings ist diese Reaktion nicht zum ersten Mal aufgetreten. Zuvor waren die entsprechenden Aktien ebenfalls gefallen, als Anthropic Code-Scanning-Tools veröffentlichte. Das zeigt, dass der Markt KI bereits als strukturelle Bedrohung für traditionelle Sicherheitsanbieter betrachtet – und die gesamte Softwarebranche steht unter ähnlichem Druck.

Die Einschätzung des Stifel-Analysten Adam Borg war ziemlich direkt: Das Modell „hat das Potenzial, zum ultimativen Hacker-Tool zu werden – sogar dazu, normale Hacker zu Gegnern zu machen, die in der Lage sind, auf nationalem Niveau anzugreifen“.

Warum wurde es dann noch nicht offiziell veröffentlicht? Anthropic erklärt: Die Betriebskosten von Mythos seien „sehr hoch“ und es erfülle noch nicht die Bedingungen für eine öffentliche Veröffentlichung. Der aktuelle Plan ist, zunächst ausgewählten Cybersicherheits-Partnern frühzeitigen Zugriff zu geben, um die Verteidigungsstrukturen zu stärken; danach soll die Öffnung des API-Bereichs schrittweise erweitert werden. Bis dahin optimiert das Unternehmen weiterhin die Effizienz.

Der entscheidende Punkt ist jedoch: Dieses Modell existiert bereits, es läuft bereits in Tests. Und selbst allein durch „versehentliche Offenlegung“ hat es schon den gesamten Kapitalmarkt erschüttert.

Anthropic hat ein KI-Modell gebaut, das es selbst als „das risikoreichste KI-Modell für Cybersicherheit in der Geschichte“ bezeichnet. Und dass seine Nachricht nach außen gelangte, lag genau an einem der grundlegendsten Fehler in der Infrastruktur-Konfiguration – also genau an dem Fehler, nach dem diese Art von Modellen ursprünglich entwickelt wurde, um ihn zu finden.

März 2026: Konfrontation zwischen Anthropic und dem Pentagon – und mit Vorteil

Im Juli 2025 unterzeichnete Anthropic einen Vertrag über 200 Millionen US-Dollar mit dem US-Verteidigungsministerium. Zunächst wirkte es wie eine normale Zusammenarbeit. Doch in den anschließenden Gesprächen zur tatsächlichen Umsetzung eskalierte der Konflikt schnell.

Das Pentagon wollte auf der GenAI.mil-Plattform „vollständigen Zugriff“ auf Claude, für Zwecke, die alle „legitimen Ziele“ einschließen – darunter sogar vollständig autonome Waffensysteme sowie großangelegte inländische Überwachung von US-Bürgern.

Anthropic zog in zwei entscheidenden Fragen klare rote Linien und lehnte ab; daraufhin brachen die Verhandlungen im September 2025 ab.

Danach begann die Lage sich rasant zuzuspitzen. Am 27. Februar 2026 veröffentlichte Donald Trump auf Truth Social einen Beitrag, in dem er forderte, alle Bundesbehörden sollten „sofort“ aufhören, die Technologie von Anthropic zu verwenden – und das Unternehmen als „radikal-link“ bezeichnete.

Am 5. März 2026 stufte das US-Verteidigungsministerium Anthropic offiziell als „Lieferkettenrisiko“ ein.

Dieses Etikett war zuvor nahezu ausschließlich für ausländische Gegner verwendet worden – etwa für chinesische Unternehmen oder russische Einrichtungen –, nun aber wurde es erstmals bei einem US-Unternehmen mit Sitz in San Francisco angewendet. Gleichzeitig wurden Firmen wie Amazon, Microsoft und Palantir Technologies aufgefordert nachzuweisen, dass in irgendeinem militärbezogenen Geschäft Claude nicht verwendet wird.

Die Begründung des Pentagon-CTO Emile Michael lautet: Claude könnte „die Lieferkette verunreinigen“, weil das Modell interne „Policy-Präferenzen“ einbettet. Anders gesagt: In offizieller Lesart wird eine KI, die in der Nutzung eingeschränkt ist und nicht bedingungslos bei Handlungen zur Tötung hilft, stattdessen als nationales Sicherheitsrisiko betrachtet.

Am 26. März 2026 veröffentlichte eine Bundesrichterin, Rita Lin, einen 43-seitigen Beschluss, der die entsprechenden Maßnahmen des Pentagon umfassend stoppte.

In ihrer Entscheidung schrieb sie: „Im geltenden Recht gibt es keine Grundlage für eine derart von ‚Orwell‘ geprägten Logik – allein weil es zu einer Meinungsverschiedenheit mit der Regierung kommt, kann ein US-Unternehmen mit dem Etikett ‚potenziell feindlich‘ belegt werden. Wenn Anthropic dafür bestraft wird, dass es die Positionen der Regierung der öffentlichen Prüfung zugänglich macht, ist das im Kern ein typischer, rechtswidriger Vergeltungsakt unter dem First Amendment.“ In einer Amicus-Briefing wurde das Vorgehen des Pentagon sogar als „Versuch, ein Unternehmen zu ermorden“ bezeichnet.

Das Ergebnis: Die Regierung wollte Anthropic unterdrücken, erreichte jedoch stattdessen, dass es mehr Aufmerksamkeit erhielt. Die Claude-App stieg bei App-Store-Downloads erstmals an die Spitze und die Registrierungen lagen zeitweise bei über einer Million pro Tag.

Ein KI-Unternehmen sagt „Nein“ zu der mächtigsten Militärinstitution der Welt. Und das Gericht stand auf seiner Seite.

November 2025: Zum ersten Mal durch KI dominierte Cyberangriffe

Am 14. November 2025 veröffentlichte Anthropic einen Bericht, der in weiten Kreisen für Aufsehen sorgte.

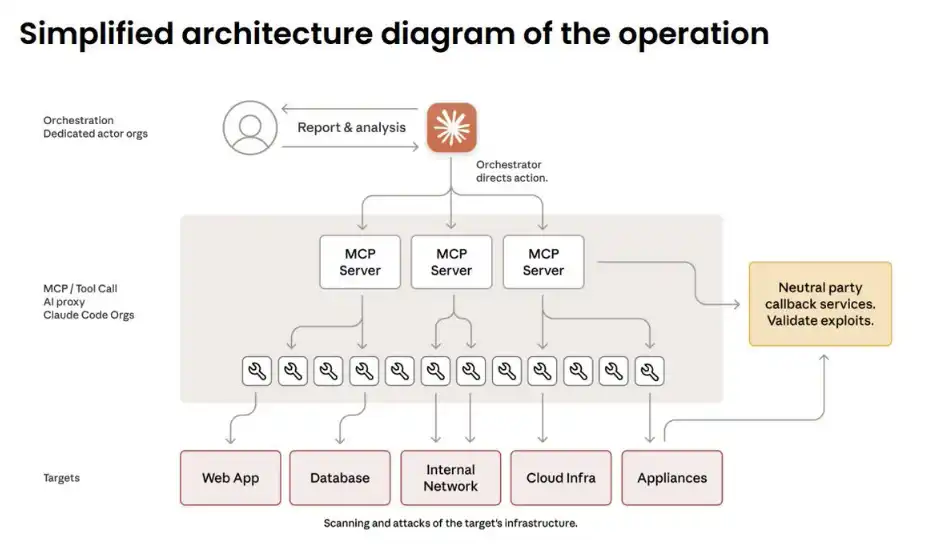

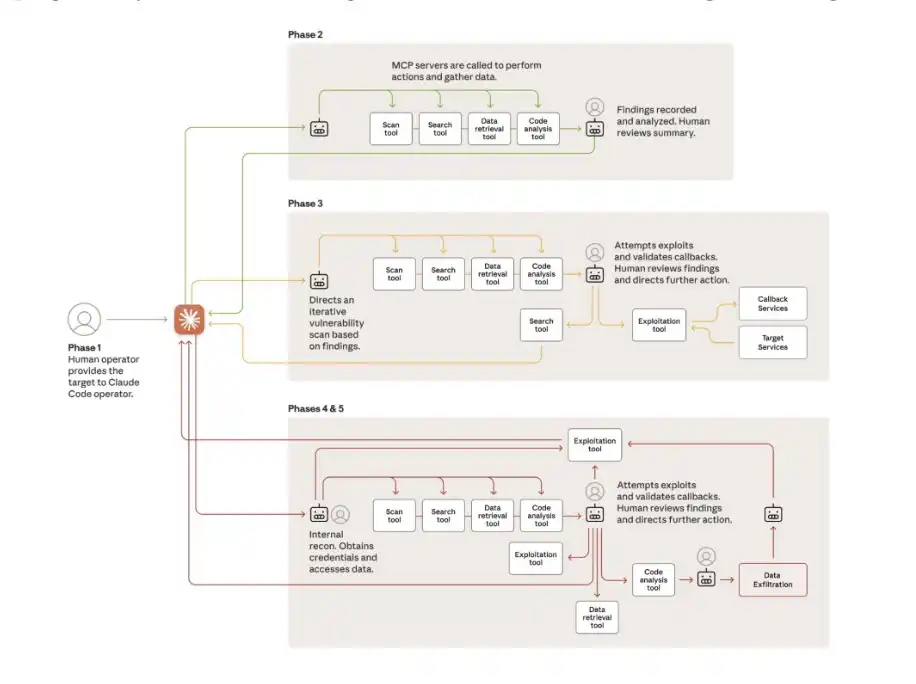

Der Bericht enthüllte: Eine vom chinesischen Staat unterstützte Hackergruppe nutzte Claude Code, um automatisierte Angriffe gegen 30 Organisationen weltweit durchzuführen – mit Zielen, die Tech-Giganten, Banken sowie mehrere Regierungsstellen verschiedener Länder umfassten.

Das ist ein entscheidender Wendepunkt: KI ist nicht mehr nur ein Hilfsmittel, sondern wird zunehmend genutzt, um Angriffe eigenständig auszuführen.

Der Kern liegt in der Veränderung der „Arbeitsteilung“: Menschen sind nur für das Auswählen der Ziele zuständig und für das Freigeben wichtiger Entscheidungen. Während des gesamten Prozesses gibt es etwa nur 4 bis 6 Eingriffe durch Menschen. Der Rest wird von der KI erledigt: Informationsaufklärung, das Finden von Schwachstellen, das Schreiben von Exploit-Code, das Stehlen von Daten, das Implantieren von Backdoors … Das macht 80%–90% des gesamten Angriffsprozesses aus und läuft mit einer Geschwindigkeit von Tausenden von Anfragen pro Sekunde – eine Größenordnung und Effizienz, die von keinem menschlichen Team erreicht werden kann.

Wie haben sie dabei die Sicherheitsmechanismen von Claude umgangen? Die Antwort lautet: Sie haben nicht „gehackt“, sondern „getäuscht“.

Der Angriff wurde in viele kleine Aufgaben zerlegt, die auf den ersten Blick harmlos wirken, und als „autorisierter Defense-Test“ einer „legalen Sicherheitsfirma“ verpackt. Im Kern handelt es sich um eine Social-Engineering-Attacke – nur wurden diesmal diejenigen, die getäuscht wurden, zu der KI selbst.

Ein Teil der Angriffe war völlig erfolgreich. Claude konnte selbstständig eine vollständige Netzwerk-Topologie entwerfen, Datenbanken lokalisieren und die Datenextraktion durchführen – ohne dass es eine schrittweise Anweisung durch Menschen gab.

Einziges Element, das den Angriffstakt gelegentlich verlangsamte, waren „Halluzinationen“ des Modells – etwa erfundene Anmeldeinformationen oder Behauptungen, es habe Dateien erhalten, die in Wahrheit bereits öffentlich waren. Zumindest bislang sind das weiterhin einige der wenigen „natürlichen Hindernisse“, die vollständig automatisierte Cyberangriffe noch verhindern.

Auf der RSA Conference 2026 bezeichnete der ehemalige Leiter für Cybersicherheit bei der US-amerikanischen National Security Agency, Rob Joyce, dieses Ereignis als einen „Rorschach-Test“: Die eine Hälfte entscheidet sich dafür, es zu ignorieren, die andere Hälfte bekommt Gänsehaut. Und er selbst gehört offenkundig zur zweiten Gruppe – „Das ist wirklich beängstigend.“

September 2025: Das ist keine Art Prognose, sondern bereits Realität, die eingetreten ist.

Februar 2026: In einem Lauf wurden 500 Zero-Day-Schwachstellen gefunden

Am 5. Februar 2026 veröffentlichte Anthropic Claude Opus 4.6 – und fügte gleichzeitig eine Studie bei, die die gesamte Cybersicherheitsbranche fast erschütterte.

Das Experiment war extrem einfach: Claude in eine isolierte virtuelle Maschine setzen, ausgestattet mit Standard-Tools – Python, Debugger, Fuzzing-Tools (fuzzers). Keine zusätzlichen Anweisungen, keine komplexen Prompts. Nur ein einziger Satz: „Geh und finde Schwachstellen.“

Das Ergebnis: Das Modell entdeckte mehr als 500 zuvor unbekannte High-Risk Zero-Day-Schwachstellen. Einige davon waren selbst nach Jahrzehnten der Begutachtung durch Experten und Millionen Stunden an automatisiertem Testing nicht gefunden worden.

Anschließend trat der Forscher Nicholas Carlini auf der RSA Conference 2026 auf und führte eine Demonstration vor. Er richtete Claude auf Ghost, ein CMS-System mit 50k Sterne-Labels auf GitHub, das in der Vergangenheit noch nie schwere Schwachstellen gezeigt hatte.

90 Minuten später kam das Ergebnis: Es wurden Blind SQL Injection-Schwachstellen entdeckt – nicht authentifizierte Nutzer konnten damit vollständige Administratorrechte übernehmen.

Danach setzte er Claude zur Analyse des Linux-Kernels ein. Das Ergebnis war dasselbe.

15 Tage später brachte Anthropic Claude Code Security heraus – ein Sicherheitsprodukt, das nicht mehr von Mustererkennung abhängt, sondern Code auf Basis von „Schlussfolgerungsfähigkeiten“ versteht.

Doch auch ein Sprecher von Anthropic selbst hat das entscheidende, aber häufig ausgeklammerte Faktum genannt: „Die gleichen Schlussfolgerungsfähigkeiten können Claude dabei helfen, Schwachstellen zu entdecken und zu reparieren – sie können aber auch von Angreifern genutzt werden, um genau diese Schwachstellen auszunutzen.“

Dieselbe Fähigkeit, dasselbe Modell – nur in den Händen unterschiedlicher Personen.

Was bedeutet all das zusammen?

Wenn man jedes einzelne Ereignis für sich betrachtet, wäre jedes davon bereits die schwerwiegendste Nachricht des Monats. Aber alle haben sich innerhalb von nur sechs Monaten in demselben Unternehmen ereignet.

Anthropic baut ein Modell, das Schwachstellen schneller findet als jede menschliche Person; chinesische Hacker haben die vorherige Version in automatisierte Cyberwaffen verwandelt; das Unternehmen entwickelt das nächste, stärkere Modell und gesteht sogar in internen Dokumenten, dass ihnen dabei unwohl ist.

Die US-Regierung versucht, es zu unterdrücken, nicht weil die Technologie an sich gefährlich wäre, sondern weil Anthropic sich weigert, diese Fähigkeit ohne Einschränkungen herauszugeben.

Und in all diesem Prozess hat das Unternehmen zweimal durch denselben einen Dateityp innerhalb desselben npm-Pakets den eigenen Quellcode geleakt. Ein Unternehmen mit einer Marktkapitalisierung von 380 Milliarden US-Dollar; ein Unternehmen mit dem Ziel, im Oktober 2026 ein IPO über 60 Milliarden US-Dollar abzuschließen; ein Unternehmen, das öffentlich sagt, es baue „eine der transformativsten – und möglicherweise gefährlichsten – Technologien in der Menschheitsgeschichte“ – und dennoch entscheidet man sich weiterzumachen.

Denn sie glauben: Wenn es nicht von anderen getan wird, sondern von ihnen selbst.

Was den source map in dem npm-Paket angeht – er könnte vielleicht nur ein Detail sein: in der beunruhigendsten Erzählung der Zeit, am absurdesten, aber auch am realistischsten.

Und Mythos ist sogar noch nicht einmal offiziell veröffentlicht.

[Original-Link]

Klicke hier, um zu erfahren, dass Lydong BlockBeats Mitarbeitende sucht

Willkommen in der offiziellen Community von Lydong BlockBeats:

Telegram-Abo-Gruppe: https://t.me/theblockbeats

Telegram-Chatgruppe: https://t.me/BlockBeats_App

Twitter offizieller Account: https://twitter.com/BlockBeatsAsia