Tại sao giá GPU lại tăng vọt không kiểm soát được?

Tiêu đề gốc: Sự thiếu hụt GPU nghiêm trọng – Công suất cho thuê – Ra mắt chỉ số giá thuê 1 năm H100 của chúng tôi

Tác giả gốc: Daniel Nishball, Jordan Nanos, Cheang Kang Wen và những người khác

Biên dịch: Peggy, BlockBeats

Lời của Ban biên tập: Khi AI chuyển từ “công cụ” sang “cơ sở hạ tầng của quy trình làm việc”, giá thuê GPU bước vào giai đoạn tăng tốc mạnh mẽ, trong khi nguồn cung tiếp tục bị siết chặt.

Từ việc giá thuê H100 kỳ hạn 1 năm tăng gần 40%, đến việc năng lực tính toán bị khóa trước đến nửa sau năm 2026, rồi đến việc các phòng thí nghiệm AI liên tục khóa nguồn cung thông qua hợp đồng dài hạn và cơ chế gia hạn, logic vận hành của thị trường GPU đã thay đổi rõ rệt: giá không còn chủ yếu do chi phí phần cứng quyết định, mà được đồng kiến tạo bởi mức tiêu thụ token, năng lực mô hình và hiệu suất sản xuất.

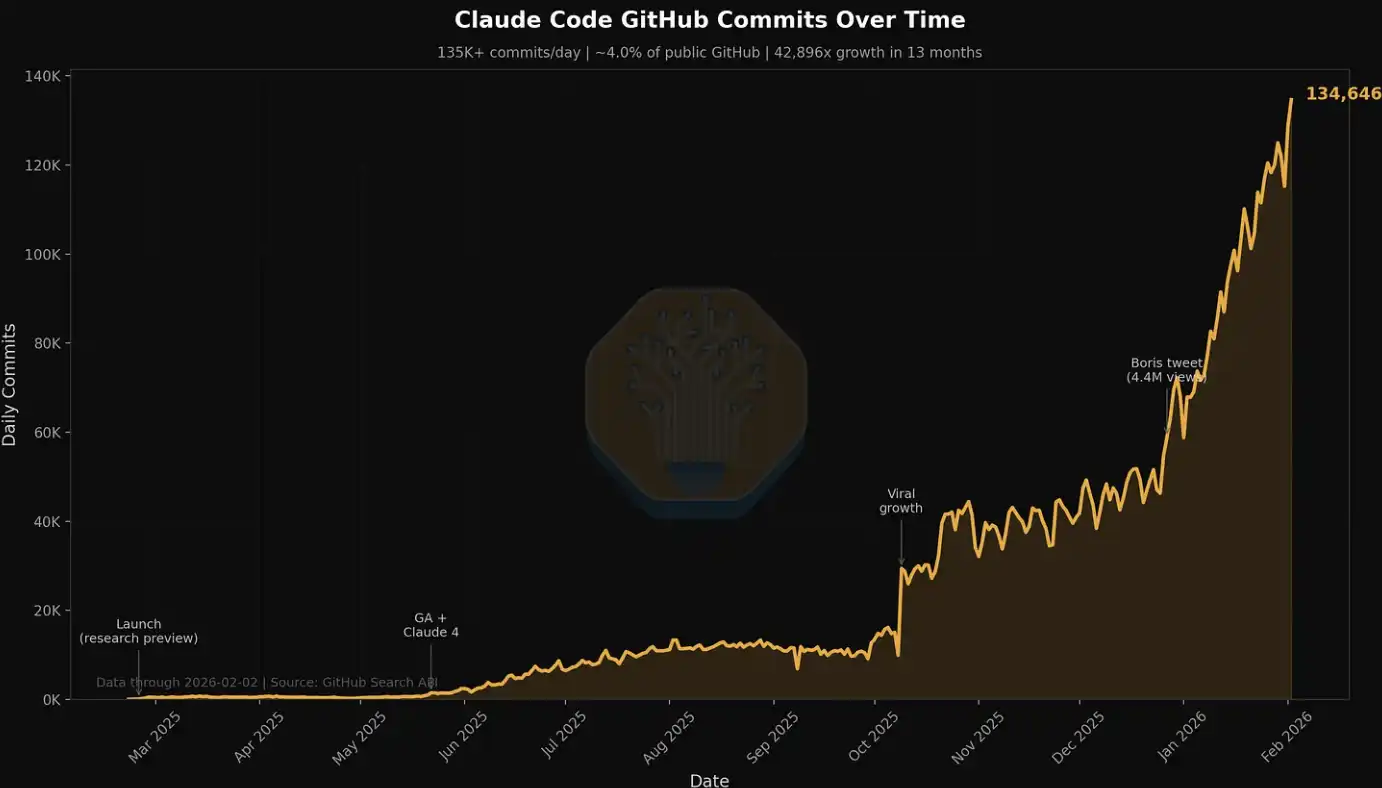

Thay đổi ở phía nhu cầu đặc biệt then chốt. Các mô hình mẫu mực mới như hệ thống đa tác tử, tạo nội dung gốc (native content generation), công cụ lập trình AI, v.v., đang đẩy việc sử dụng token vào khoảng tăng trưởng theo cấp số. Nhận định cốt lõi của báo cáo cũng dần trở nên rõ ràng: tỷ lệ đầu ra/đầu vào (ROI) của công cụ AI đã được kiểm chứng, với mức lợi nhuận gấp 5–10 lần, khiến giá năng lực tính toán trong một khoảng thời gian khá dài khó có thể tạo ra ràng buộc hiệu quả lên nhu cầu.

Từ đó hình thành một sự giằng co ngày càng rõ: thị trường năng lực tính toán ngoài đời đang thể hiện tình trạng thiếu hụt toàn diện và quyền định giá được đẩy lên cao, trong khi thị trường vốn vẫn bám vào kỳ vọng “rốt cuộc sẽ thừa và bị hàng hóa hóa”. Sự lệch pha giữa kỳ vọng và thực tế này đang định hình lại logic định giá của phân khúc hạ tầng AI.

Khi năng lực tính toán trở thành tư liệu sản xuất mới, cơ chế giá cả, cấu trúc nguồn cung và lợi nhuận vốn của nó đang bước vào một vòng tái cấu trúc sâu sắc.

Dưới đây là bản gốc:

Nhu cầu đối với Claude 4.6 Opus của Anthropic và Claude Code bùng nổ mạnh mẽ. Doanh thu thường niên (ARR) của họ trong vòng chưa đầy một quý, từ cuối năm ngoái là 48kỷ đô la Mỹ đã nhảy lên hơn 24kỷ đô la Mỹ hiện tại, gần như đạt mức tăng trưởng gấp ba. Đồng thời, các mô hình mã nguồn mở, đại diện bởi GLM và Kimi K2.5, cũng thúc đẩy nhanh việc mở rộng các kịch bản ứng dụng liên quan đến mô hình mã nguồn mở. Các doanh nghiệp tiếp tục huy động vốn, bao gồm Anthropic, OpenAI và nhiều Neolabs khác, cũng đồng thời làm gia tăng nhu cầu đối với tài nguyên GPU.

Ngã rẽ này có nghĩa là nhu cầu tăng vọt trong thời gian ngắn, và các siêu nhà cung cấp đám mây cực lớn (hyperscalers) cùng các nhà cung cấp dịch vụ đám mây mới nổi (Neoclouds) đã xuất hiện làn sóng “mua giành” GPU.

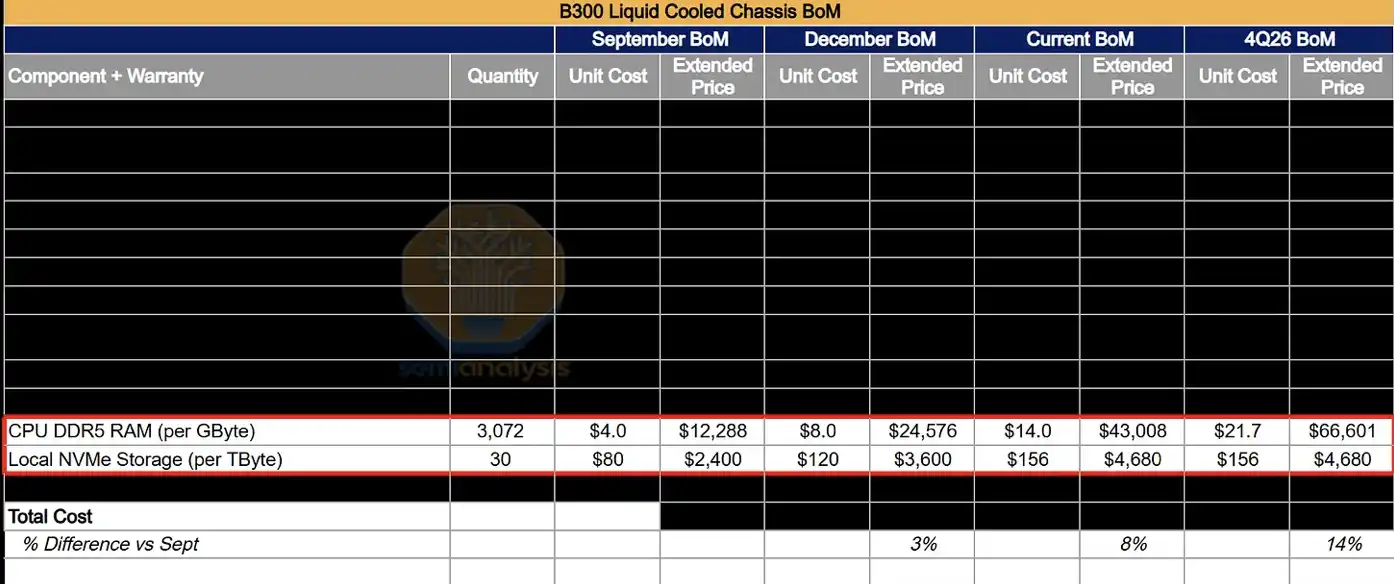

Nhu cầu mới này đang đẩy giá tăng dọc theo toàn bộ chuỗi cung ứng, từ DRAM và bộ nhớ NAND, đến cáp quang, lưu trữ/thuê chỗ tại trung tâm dữ liệu, rồi đến các cơ sở hạ tầng như tua-bin khí, gần như tất cả các sản phẩm và dịch vụ liên quan đều tăng giá.

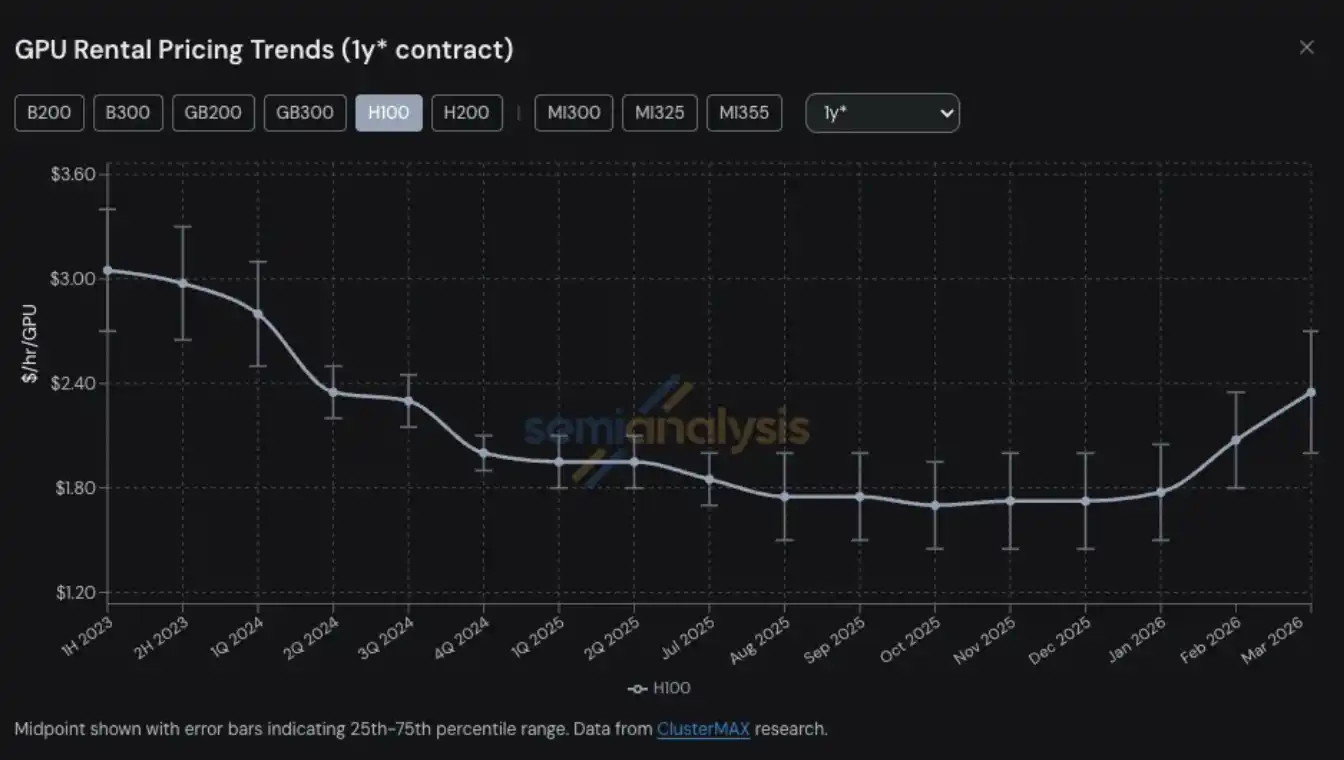

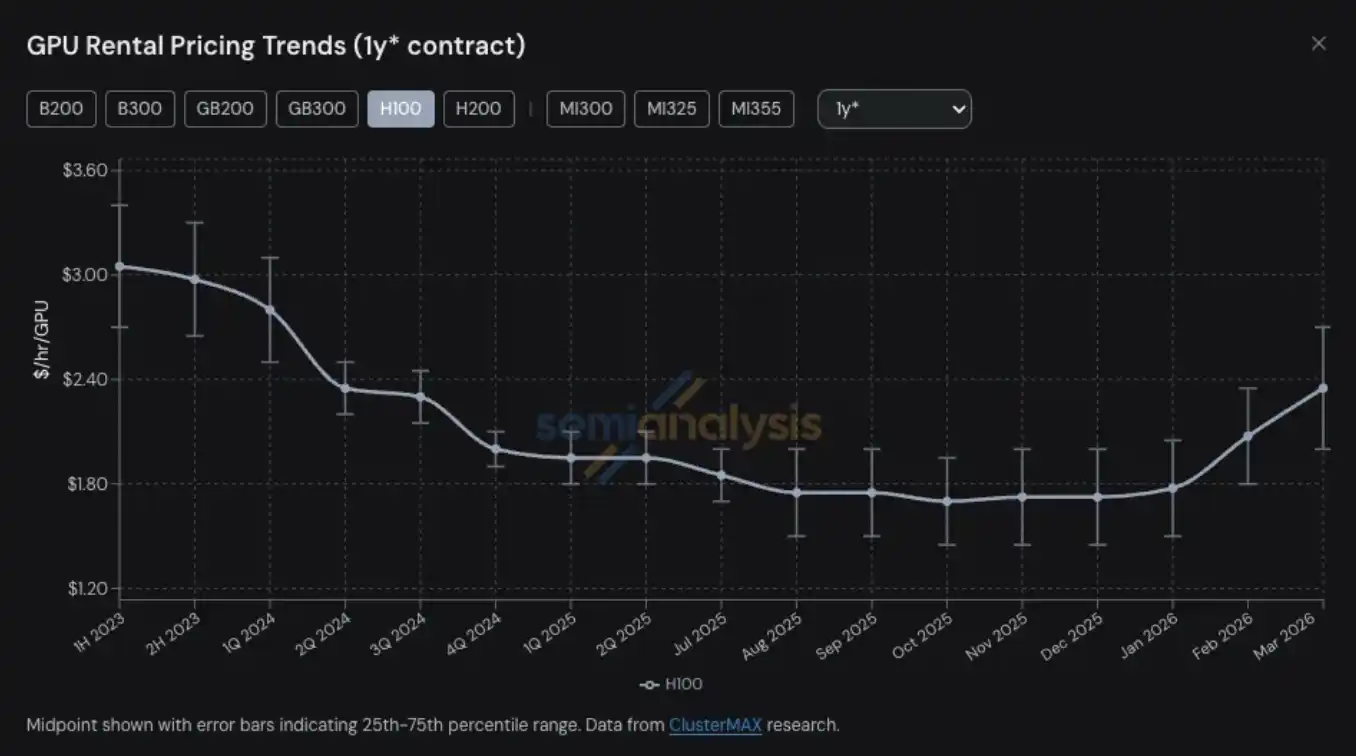

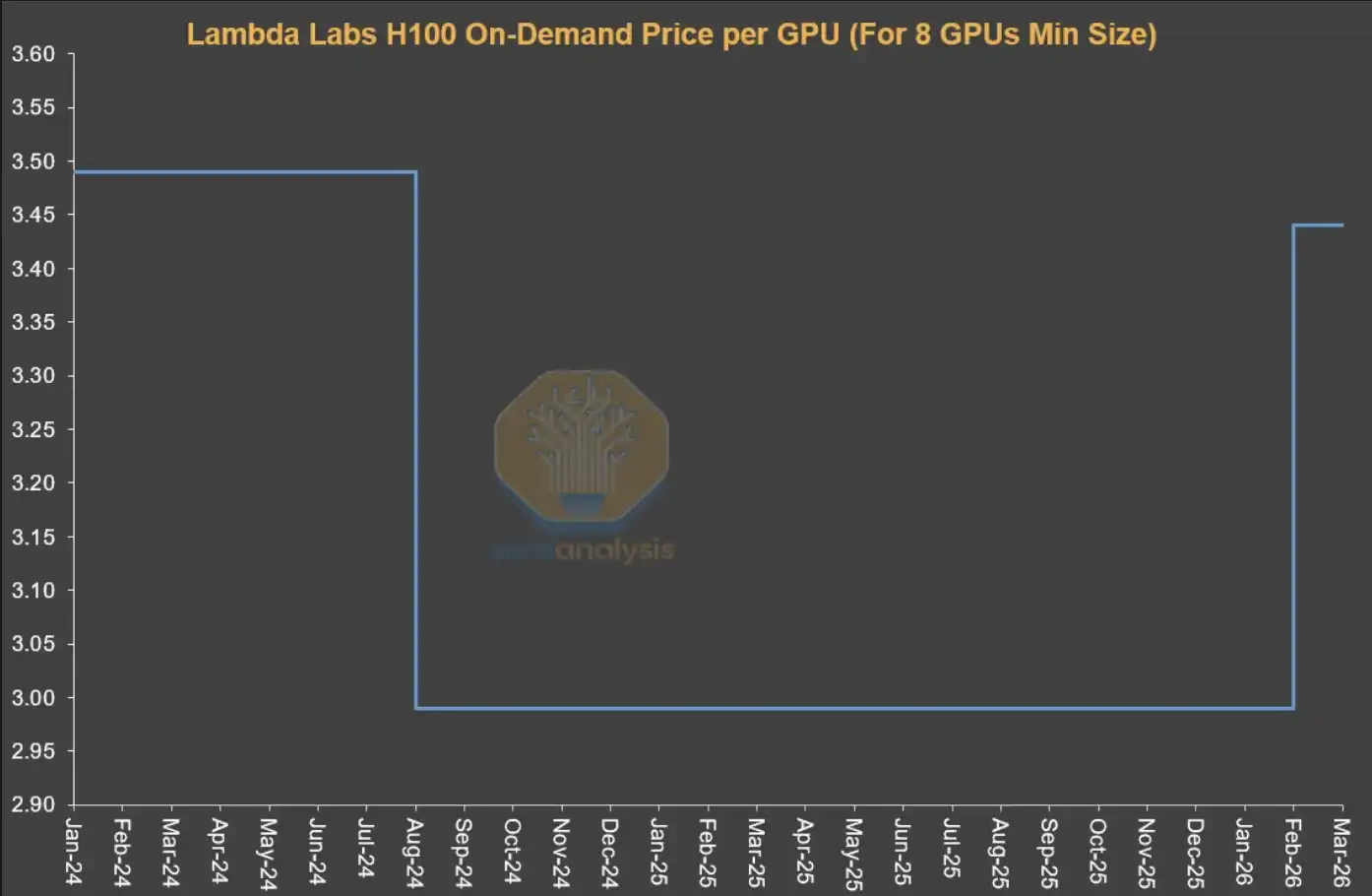

Giá thuê GPU đã trở thành một trong nhiều sản phẩm và dịch vụ liên quan đến năng lực tính toán, là lĩnh vực mới nhất xuất hiện tình trạng căng thẳng nguồn cung và nhảy vọt về giá. Giá hợp đồng thuê GPU kỳ hạn 1 năm của H100, từ mức thấp mỗi GPU mỗi giờ 1.70 đô la Mỹ vào tháng 10 năm 2025, đã tăng lên 2.35 đô la Mỹ vào tháng 3 năm 2026, mức tăng gần 40%.

Công suất thuê GPU theo nhu cầu (on-demand) hầu như đã bán hết trên mọi cấu hình — những người dùng đã khóa các instance theo nhu cầu, dù sau khi giá tăng vẫn không muốn trả lại năng lực tính toán cho thị trường. Đầu năm 2026, độ khó khi tìm kiếm năng lực tính toán GPU gần như giống như việc cố giành vé cho “chuyến bay cuối cùng”: giá cao ngất, gần như không còn vé. Nếu dùng phép so sánh sát hơn, thay vì nói là giành vé máy bay, thì giống hơn với việc “tìm kênh mua thuốc”.

Tại SemiAnalysis, chúng tôi theo dõi sâu và dài hạn nhiều xu hướng và vấn đề trọng yếu trong hệ sinh thái Neocloud và đám mây siêu quy mô, trong đó có giá thuê GPU. Năng lực này đến từ việc chúng tôi duy trì nghiên cứu và thực hành trong các dự án như ClusterMAX, InferenceX và AI Cloud TCO (Tổng chi phí sở hữu).

Trong khi đó, chúng tôi cũng dồn rất nhiều công sức để giúp các phòng thí nghiệm AI kết nối với các nhà cung cấp dịch vụ Neocloud, tìm tài nguyên thuê GPU trên thị trường, đồng thời liên tục trao đổi với gần như toàn bộ các bên tham gia trong hệ sinh thái về xu hướng biến động giá thuê GPU.

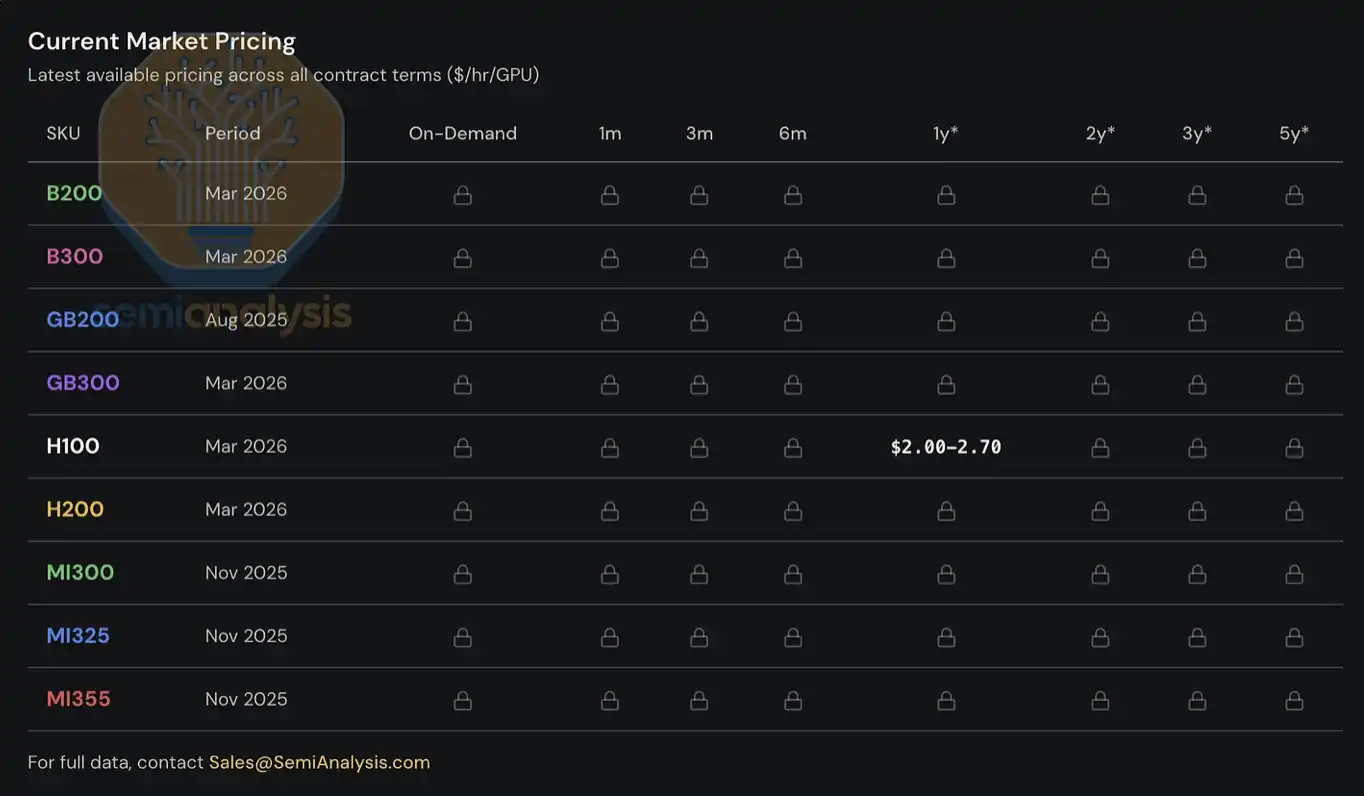

Từ năm 2023, chúng tôi đã xây dựng và duy trì một hệ thống chỉ số giá thuê GPU cho khách hàng, bao phủ các mẫu GPU phổ biến (như H100, H200, B200, B300, GB200, GB300, MI300, MI325, MI355), và trải rộng qua các kỳ hạn thuê khác nhau, từ theo nhu cầu (on-demand), cho thuê ngắn 1 tháng, đến hợp đồng dài hạn tối đa 5 năm. Chỉ số này được xây dựng dựa trên dữ liệu khảo sát từ nhiều nhà cung cấp Neocloud và bên mua năng lực tính toán, đồng thời được xác minh chéo thông qua dữ liệu giao dịch thực tế, cũng như các cuộc đàm phán và tình trạng chốt giao dịch mà chúng tôi tham gia.

Hôm nay, chúng tôi mở cho công chúng chỉ số giá thuê GPU kỳ hạn 1 năm của H100, với mong muốn cung cấp thêm dữ liệu và góc nhìn cho ngành. Chỉ số được cập nhật theo tháng, và chúng tôi cũng sẽ liên tục đăng tải các phân tích xu hướng và quan sát thị trường mới nhất thông qua X và LinkedIn. Còn đối với dữ liệu định giá đầy đủ bao gồm cấu trúc nhiều kỳ hạn thuê khác nhau và các mẫu GPU chủ đạo khác, hiện chỉ dành cho người dùng tổ chức đăng ký mô hình AI Cloud TCO của chúng tôi.

Báo cáo này sẽ tập trung vào các xu hướng mới nhất của thị trường thuê GPU, quan sát ở tuyến đầu thị trường và các dữ liệu then chốt, phân tích cách chúng tôi hiểu cấu trúc tổng thể của thị trường, đồng thời đưa ra dự phán ban đầu về hướng đi của giá thuê trong tương lai.

Thị trường thuê GPU bước vào giai đoạn “định giá động”

Chỉ xét riêng đường cong giá thuê kỳ hạn 1 năm của H100, vẫn chưa đủ để phản ánh trọn vẹn mức độ căng thẳng của thị trường — những gì được phản ánh rõ hơn là nghiêm trọng hơn, dựa trên trải nghiệm thực tế của chúng tôi khi lấy năng lực tính toán ở tuyến đầu, cùng với phản hồi từ các bên tham gia thị trường.

Nhu cầu hiện tại đến từ nhiều kịch bản sử dụng có mức độ dị biệt cực cao, gần như không tồn tại “giải pháp chung”. Ví dụ, ở phía suy luận (inference), mô hình MoE (Mixture of Experts – mô hình chuyên gia hỗn hợp) quy mô lớn phù hợp hơn để chạy trên các hệ thống quy mô lớn mới nhất như GB300 NVL72; còn ở phía huấn luyện (training), H100 vẫn có lợi thế về hiệu quả chi phí, khiến ngay cả những GPU thuộc “thế hệ cũ hơn” tương đối vẫn giữ nhu cầu ở mức cao.

Hiện nay khách hàng thậm chí đang tranh nhau trả 14 đô la Mỹ mỗi GPU mỗi giờ cho giá instance dạng “giành trước” trên AWS p6-b200; một số nhà cung cấp Neocloud hàng đầu đã không còn bán theo single-node nữa; một phần giá gia hạn của H100 lại, thật bất ngờ, hoàn toàn giống với giá đã ký cách đây hai đến ba năm; ngoài ra còn có một số hợp đồng H100 đã được gia hạn trực tiếp đến năm 2028, thời hạn thuê lên tới 4 năm. Giờ muốn tìm một cụm H100 hoặc H200 ngay cả với 8 node (64 GPU), cũng không hề dễ — trong số các nhà cung cấp mà chúng tôi hỏi, một nửa đã hoàn toàn hết hàng, còn đa số phản hồi lại là: căn bản không có bất kỳ GPU kiến trúc Hopper nào sẽ đáo hạn hợp đồng trong thời gian gần để “được thả ra”.

Chúng tôi thậm chí nghe nói rằng một số bên thuê năng lực tính toán đã bắt đầu tháo rời chính cụm mà họ thuê rồi chuyển cho thuê lại lần nữa, y như việc tách căn hộ để cho thuê ngắn trong thời gian diễn ra giải Grand Prix Monaco. Liệu sau đó có xuất hiện cái gọi là “Neocloud nhượng lại” (second landlord) hay không, có lẽ không còn chỉ là chuyện đùa nữa.

Nguồn cung của Blackwell cũng đang cực kỳ căng. Chúng tôi biết rằng, do nhu cầu mạnh mẽ đối với các mô hình trọng số mã nguồn mở, cùng với nhu cầu suy luận tiếp tục bùng nổ, thời gian triển khai và bàn giao các cụm Blackwell mới dự kiến đã kéo dài đến khoảng tháng 6 đến tháng 7. Hơn nữa, phần lớn các cụm sắp được đưa vào vận hành này cũng đã được khóa trước. Thực tế, nhìn trên toàn thị trường, đến tận tháng 8–9 năm 25Bới có thêm công suất mới đi vào hoạt động, gần như đều đã được đặt trước hết.

Giá thuê GPU: lại trở lại trong làn sóng

Nhưng tại sao thị trường lại đi đến bước này? Ngay 6 tháng trước, đa số người quan sát thị trường vẫn nghi ngờ về “giá trị cuối cùng” (terminal value) của GPU và phổ biến cho rằng giá thuê GPU theo thời gian sẽ không thể tránh khỏi tiếp tục giảm. Khi đó, nếu trong mô hình tài chính, một Neocloud hoặc nhà cung cấp đám mây cực lớn dùng chu kỳ khấu hao 6 năm để xử lý tài sản năng lực tính toán của GPU, thậm chí còn có thể bị các nhà phân tích tài chính chỉ trích. Trước khi bàn về xu hướng tương lai, chúng ta hãy nhìn nhanh xem mọi thứ đã diễn biến thế nào để đi đến đây.

Trước nửa cuối năm 2025, kỳ vọng chủ đạo của toàn bộ hệ sinh thái là: khi Blackwell được triển khai quy mô lớn và chi phí đơn vị cho năng lực tính toán của nó thấp hơn đáng kể, giá thuê của Hopper (tức H100 và H200) sẽ giảm rõ rệt. Nhưng thực tế lại hoàn toàn ngược lại. Đến nửa cuối năm 2025, nhu cầu đối với H100 không những không suy yếu mà còn tăng mạnh trong nhiều tình huống. Sự phổ biến nhanh của các mô hình trọng số mã nguồn mở, cùng với việc nhu cầu suy luận lúc bấy giờ tiếp tục tăng tốc, là tín hiệu sớm nhất của làn sóng nhu cầu năng lực tính toán gần như không có điểm dừng này.

Đến tháng 1 năm 2026, thị trường năng lực tính toán bước vào một điểm ngoặt tiếp theo: sau nhiều quý giá lưu trữ DRAM và NAND tăng nhanh, chúng bắt đầu bước vào giai đoạn bùng nổ gần như “theo hình parabol”. Theo mô hình lưu trữ của chúng tôi, trong quý 1 năm 2026, mức tăng theo năm của giá hợp đồng LPDDR5 và DDR5 lần lượt tiến gần khoảng 4 lần và 5 lần.

Để đối phó với rủi ro biên lợi nhuận do chi phí linh kiện tăng mạnh, các nhà sản xuất OEM bắt đầu điều chỉnh tăng giá bán máy chủ AI, và mức tăng giá này rõ ràng cao hơn so với mức tăng của chính linh kiện nền tảng. Điều này làm cho quyết định chi CapEx của cụm trở nên phức tạp hơn: chi phí mua máy chủ cao hơn làm nén lợi nhuận kỳ vọng của dự án, khiến một số nhà vận hành phải chậm nhịp triển khai, thậm chí trực tiếp từ bỏ việc triển khai dự án. Kết quả là, một phần nguồn cung bổ sung vốn có thể được đưa vào vận hành đã bị trì hoãn hoặc bỏ ngỏ, từ đó làm gia tăng thêm tình trạng căng thẳng trong thị trường thuê.

Trong cơn hỗn loạn mua sắm do “định giá máy chủ AI mất kiểm soát” này, nhu cầu thuê GPU tăng tốc đáng kể; phần năng lực tính toán vốn còn lại trên thị trường hầu như đã bị tiêu thụ hoàn toàn trong tháng 1 và tháng 2. Đến tháng 3, bất kể H100, H200 hay B200, gần như không thể tìm thấy năng lực khả dụng trong bất kỳ kỳ hạn thuê nào. Giá thuê kỳ hạn 1 năm đã vượt mốc 2 đô la Mỹ mỗi GPU mỗi giờ ngay cuối tháng 1, và giữa tháng 2 đến nửa cuối tháng 2 đã tăng thêm 15%–20% so với cuối tháng 1; dự kiến đến cuối tháng 3, mức giá sẽ lại tăng 15%–20% theo vòng tháng so với cuối tháng 2.

Một trong những động lực quan trọng cho nhu cầu đầu năm nay đến từ việc tạo nội dung gốc (native media generation). Những ứng dụng như Seedance, Nano Banana đang thúc đẩy người dùng tạo và lặp lại (iterate) hình ảnh và video theo quy mô, từ đó cải thiện đáng kể thông lượng (token throughput). Nhưng nguồn nhu cầu quan trọng hơn, đồng thời cũng dễ quan sát hơn, là sự trỗi dậy của khối lượng công việc đa tác tử (multi-agent) — các hệ thống này thực hiện quy trình nhiều bước, liên tục lặp lại trong môi trường có mức độ đồng thời cao, kéo theo tiêu thụ token và nhu cầu năng lực tính toán tăng trưởng “theo cấp số mũ”.

Xu hướng này thể hiện đặc biệt rõ trong dữ liệu liên quan của Claude Code, điều mà trước đây chúng tôi đã đề cập trong nhiều bài viết. Ví dụ như SemiAnalysis: chỉ trong 7 ngày gần đây, bên trong công ty đã tiêu thụ hàng chục tỷ token, với chi phí trung bình khoảng 5 đô la Mỹ cho mỗi 8B token. Nhưng những lợi ích về tiết kiệm thời gian, mở rộng quy trình làm việc và tăng cường năng lực vượt xa bản thân chi phí. Hiện tại, SemiAnalysis đã nhúng trọn bộ công cụ AI vào nhiều quy trình làm việc; không còn giới hạn ở tìm kiếm và tóm tắt đơn giản, mà mở rộng sang dashboard dữ liệu, thu thập tự động quy mô lớn, xử lý dữ liệu quy mô lớn, cũng như mô hình hóa tài chính dựa trên tác tử (agent-based) và các tình huống tương tự.

Chúng tôi cũng theo dõi sự bùng nổ nhu cầu này thông qua các chỉ số như số lần nộp hằng ngày của Claude (Claude Commits Daily). Theo xu hướng hiện tại, chúng tôi dự đoán đến cuối năm 2026, Claude Code sẽ chiếm hơn 20% tổng số lần commit mã. Có thể nói, trong khoảng thời gian mà bạn còn chưa kịp nhận ra, AI đã bắt đầu “nuốt trọn” cả quy trình phát triển phần mềm. Với khách hàng tổ chức muốn có tập dữ liệu này, hãy liên hệ với nhóm API của chúng tôi. Tiết lộ trước một chút: số lần commit này đã cao hơn rõ rệt so với mức mà chúng tôi công bố lần đầu.

Trong cộng đồng của chúng tôi, gần như ai cũng là người dùng nặng Claude Code. Nhưng chúng tôi cũng hiểu rằng bản thân “cộng đồng” này vốn dĩ sâu trong lĩnh vực AI và bán dẫn, về bản chất chỉ là một “nhóm nhỏ ở tuyến đầu”.

Đối với nhiều doanh nghiệp trong danh sách Fortune 500 và rộng hơn là công chúng nói chung, Claude Code và “thế giới của các tác tử” chỉ là một chủ đề mới lạ ở rìa giới, thỉnh thoảng xuất hiện trên Facebook newsfeed hoặc podcast của NPR. Họ gần như chưa nhận ra rằng một làn sóng năng suất làm việc do tác tử dẫn dắt, cùng với các cú sốc mang tính cấu trúc, đang tiến đến gần.

Khi ngày càng có nhiều bên tham gia từ nền kinh tế thực thể dần nhận thức được lợi nhuận đầu tư đáng kinh ngạc khi sử dụng công cụ AI và bước vào “làn sóng năng lực tính toán” này, thì mức tiêu thụ token sẽ tiếp tục tăng theo từng bậc. Tranh luận về tỷ lệ đầu ra/đầu vào của AI, thực ra đã có kết luận — giá trị được tạo ra từ việc sử dụng công cụ AI thường đạt tới hơn một bậc độ lớn so với chi phí của nó. Trong bối cảnh đó, đường cong nhu cầu token tiếp tục dịch sang phải (tăng lên), đang hình thành một lực mạnh mẽ và (ở giai đoạn hiện tại) tương đối thiếu độ co giãn, qua đó thúc đẩy giá thuê GPU liên tục đi lên.

Nói một cách đơn giản: nếu ROI khi sử dụng công cụ AI có thể đạt 5–10 lần, thì vẫn còn không gian tăng lên đáng kể cho giá thuê GPU, để khi đó nó mới thật sự có thể kìm hãm nhu cầu. Chúng tôi cũng không loại trừ khả năng rằng, việc giá thuê tiếp tục tăng thêm sẽ còn lan truyền theo chiều đi lên, đẩy chi phí máy chủ và các linh kiện lõi.

Công bố chỉ số giá thuê GPU H100 kỳ hạn 1 năm của SemiAnalysis

Hôm nay, chúng tôi mở miễn phí cho công chúng chỉ số giá hợp đồng thuê GPU H100 kỳ hạn 1 năm của SemiAnalysis, nhằm nâng cao nhận thức và tính minh bạch của thị trường về xu hướng giá thuê GPU.

Chỉ số này được xây dựng dựa trên dữ liệu khảo sát theo tháng từ hơn 9Bên tham gia thị trường (bao gồm nhà cung cấp Neocloud, bên mua năng lực tính toán và bên bán), để xác định khoảng đại diện của giá thuê GPU (từ phân vị thứ 25 đến phân vị thứ 75). Đồng thời, chúng tôi còn xác minh chéo thông qua dữ liệu giao dịch thực tế, và trong mạng lưới của mình tổ chức việc ghép nối bên mua và bên bán, trực tiếp tham gia vào một phần giao dịch, nhằm hiệu chỉnh thêm mức giá.

Từ năm 2023, chúng tôi liên tục theo dõi giá hợp đồng của GPU, bao gồm H100, H200, B200, B300, GB200 và GB300, trong nhiều kỳ hạn thuê từ 3 tháng đến 5 năm; đồng thời cũng đưa vào dữ liệu liên quan của dòng AMD (MI300, MI325, MI355).

So với các chỉ số GPU hiện có trên thị trường, chỉ số giá hợp đồng thuê GPU H100 kỳ hạn 1 năm của SemiAnalysis có một số khác biệt then chốt:

Trước hết, nhiều chỉ số thuê GPU dựa trên báo giá giao ngay/theo nhu cầu (spot/on-demand) hoặc giá niêm yết công khai, nhưng thực tế thì phần lớn giao dịch thuê GPU được thực hiện thông qua hợp đồng dài hạn, thường có thời hạn từ 6 tháng trở lên. Những mức giá này thường được hình thành thông qua đàm phán song phương và không xuất hiện trong bất kỳ cơ sở dữ liệu công khai nào. Đa số nhà cung cấp Neocloud lớn có xu hướng ký hợp đồng từ ít nhất 1 năm, 2–3 năm là lý tưởng hơn, và nếu có thể đạt được thỏa thuận bao tiêu 5 năm quy mô lớn thì càng tốt. Chỉ số thuê GPU H100 kỳ hạn 1 năm của SemiAnalysis chính là tập trung vào “thị trường hợp đồng” này — tức phần có khối lượng giao dịch thực tế lớn nhất. Bằng cách xác định rõ một kỳ hạn cụ thể, chỉ số cũng dễ giúp người dùng hiểu hơn khoảng thị trường mà nó bao phủ, đồng thời đối chiếu với quan sát của chính họ.

Thứ hai, giá được công bố công khai không đại diện cho giá thực tế đã chốt. Giá do các nhà cung cấp đám mây cực lớn và Neocloud công bố thường chủ yếu nhằm cung cấp tham chiếu theo hướng xu thế, chứ không phản ánh mức độ giao dịch thực tế. Các mức giá này thường đi sau những biến động của thị trường hợp đồng; thông thường, chúng chỉ được điều chỉnh sau khi nhu cầu về năng lực tính toán đã chuyển dịch. Đặc biệt trong thị trường theo nhu cầu, giá thường được đặt ở mức tương đối cố định; còn sự thay đổi về cung cầu thực tế lại thể hiện qua mức sử dụng hoặc tỷ lệ chiếm dụng tài nguyên, chỉ khi cần thiết mới điều chỉnh không thường xuyên. Cơ chế thị trường này sẽ được giải thích thêm ở phần sau của bài viết.

Thứ ba, dù trên thị trường cũng có nhiều chỉ số có thể xử lý báo giá, giá và dữ liệu giao dịch quy mô lớn, đồng thời có ưu thế trong phân tích xu hướng, nhưng cách tiếp cận của chúng tôi nhấn mạnh hơn vào tương tác trực tiếp với các bên tham gia thị trường. Mỗi báo giá và mỗi giao dịch đều có bối cảnh và logic ra quyết định cụ thể riêng đằng sau nó. Chúng tôi mong muốn, cùng với việc trình bày dữ liệu định lượng, cũng bổ sung các thông tin định tính và quan sát ở tuyến đầu để tái hiện đầy đủ hơn cấu trúc thực sự của thị trường thuê GPU.

Đối với người dùng tổ chức đăng ký, chúng tôi cũng cung cấp dữ liệu cấu trúc kỳ hạn đầy đủ bao phủ gần như toàn bộ các thị trường thuê GPU phổ biến.

Song song với việc công bố chỉ số giá hợp đồng thuê H100 kỳ hạn 1 năm, chúng tôi cũng phát hành cho người dùng đăng ký mô hình Tokenomics ở cấp tổ chức của SemiAnalysis một SemiAnalysis Tokenomics Dashboard, nhằm theo dõi và hiểu bức tranh các mô hình AI tiên phong. Bảng điều khiển hỗ trợ người dùng tùy chỉnh so sánh theo nhiều chiều như code, suy luận, đánh giá toán học và tác tử; so sánh API pricing của các mô hình và nhà cung cấp dịch vụ khác nhau; đồng thời xem các dữ liệu then chốt mà các phòng thí nghiệm AI lớn công bố, bao gồm lượng token sử dụng, doanh thu, định giá và quy mô khách hàng.

Cấu trúc hiện tại của thị trường thuê GPU

Trước nửa cuối năm 2025, môi trường định giá của thị trường thuê GPU tương đối mang tính cạnh tranh hơn. Khi đó, các nhà vận hành sở hữu nhiều kho GPU hơn, còn nhu cầu ở đầu cuối mới bắt đầu tăng tốc. Vì vậy, cạnh tranh giữa các nhà cung cấp Neocloud diễn ra gay gắt; nhìn chung họ giành giật khách hàng thông qua mức giá hấp dẫn hơn. Mục tiêu cốt lõi là tăng tỷ lệ sử dụng, tận dụng tối đa giá trị của tài sản năng lực tính toán hiện có trước khi đến chu kỳ lặp GPU tiếp theo.

Nhưng từ đó, bức tranh thị trường đã xoay 180 độ. Hiện nay, Neocloud và các nhà cung cấp đám mây cực lớn đã nắm trọn quyền chủ động — họ có thể đòi hỏi trả trước cao hơn, định giá tốt hơn, thời hạn hợp đồng dài hơn, thậm chí tự chọn thời điểm bắt đầu và kết thúc hợp đồng để phù hợp với sắp xếp tồn kho và công suất của mình. Đồng thời, thời gian cũng đứng về phía nguồn cung: họ có thể đẩy tiến độ triển khai theo nhịp của riêng mình và, trong bối cảnh giá tiếp tục tăng, từng bước lọc ra tổ hợp khách hàng chất lượng nhất.

Xét theo cấu trúc, thị trường thuê GPU có thể chia đại khái thành ba mảng lớn, tương ứng với các kiểu nhu cầu khác nhau của khách hàng:

Thuê ngắn hạn: theo nhu cầu (on-demand), spot (chiếm dụng/tranh chấp chỗ) và hợp đồng dưới 3 tháng

Hợp đồng trung hạn: hợp đồng từ 3 tháng đến từ 3 năm trở lên

Bao tiêu dài hạn (offtake): hợp đồng kỳ 4–5 năm, trong đó 5 năm là phổ biến nhất

Thuê ngắn hạn: theo nhu cầu, spot và hợp đồng dưới 3 tháng

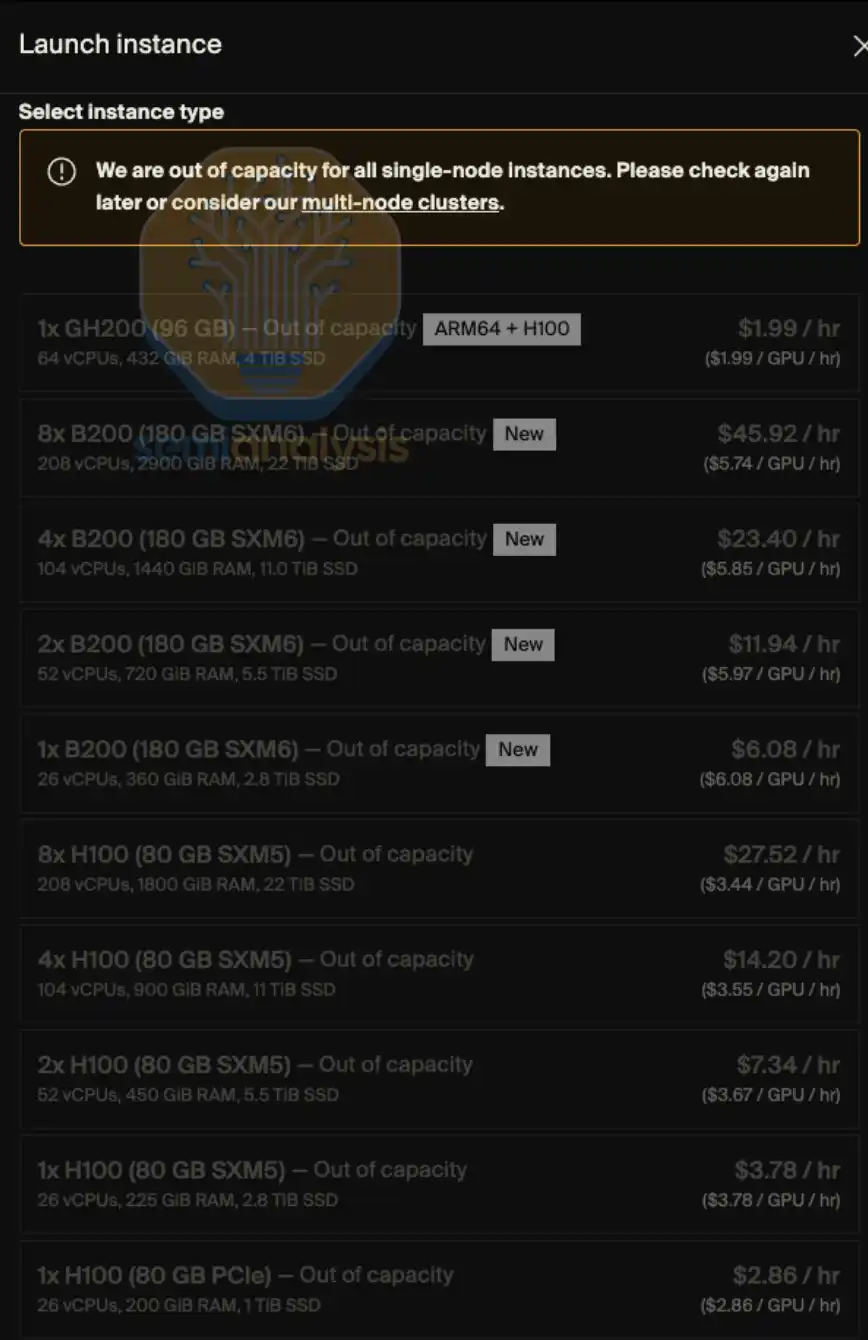

Thuê ngắn hạn nằm ở phía đầu của toàn bộ cấu trúc kỳ hạn thuê; trong nhiều trường hợp nó tương ứng với “năng lực công suất còn lại”. Tuy nhiên, cũng có một số nhà cung cấp (như Runpod, Lambda) tập trung cung cấp năng lực tính toán theo nhu cầu hoặc spot linh hoạt với quy mô đáng kể.

Cần lưu ý rằng cơ chế định giá của thị trường theo nhu cầu có sự khác biệt đáng kể so với các thị trường hợp đồng khác. Thông thường, nhà cung cấp sẽ đặt một mức giá tương đối cố định cho tài nguyên theo nhu cầu và chỉ điều chỉnh trong rất ít trường hợp. Nói cách khác, giá ở thị trường ngắn hạn không hoàn toàn được thúc đẩy trực tiếp bởi cung cầu thời gian thực, mà phản ánh mức căng thẳng thị trường chủ yếu thông qua sự thay đổi của tỷ lệ sử dụng tài nguyên.

Nhà cung cấp thường điều chỉnh giá một lần dựa trên tỷ lệ sử dụng tài nguyên: khi tỷ lệ sử dụng thấp, họ sẽ giảm giá để kích thích nhu cầu; còn khi tỷ lệ sử dụng gần như đầy tải, họ sẽ tăng giá, vì dù ở mức giá cao hơn thì nhu cầu vẫn có thể duy trì ở mức cao.

Điều này cũng giải thích vì sao, khi nhìn theo chuỗi thời gian, giá theo nhu cầu mà Neocloud công bố thường giữ nguyên trong một thời gian dài rồi đột ngột xuất hiện “bước nhảy” theo hướng tăng hoặc giảm. Với thị trường theo nhu cầu, thứ thực sự phản ánh biến động nhu cầu với tần suất cao không phải là giá, mà là tỷ lệ sử dụng tài nguyên.

Nguồn: Lambda Labs, SemiAnalysis

Hợp đồng trung hạn (Mid-Term Contracts)

Về ý nghĩa kinh tế, điều quan trọng hơn thực chất là “thị trường hợp đồng”, bởi phần lớn giá trị giao dịch thuê GPU xảy ra ở mảng này. Trong đó, hợp đồng 1 năm đặc biệt quan trọng — nó vừa phản ánh nhu cầu cận biên của các khách hàng không phải phòng thí nghiệm AI, vừa thể hiện nhu cầu tràn (overflow) từ các khách hàng lớn, do đó là chỉ báo nhạy cảm nhất để đánh giá mức độ thị trường bị siết chặt.

Các công ty AI gốc (AI Natives) và các phòng thí nghiệm AI trung nhỏ chủ yếu hoạt động trong khoảng kỳ hạn 1–3 năm. Tuy nhiên, một xu hướng gần đây rõ rệt là các tổ chức này cũng bắt đầu thử khóa tài nguyên năng lực tính toán thông qua hợp đồng dài hơn — nhiều bên đã mở rộng đến 4 năm trở lên, và sẵn sàng trả trước hơn 20%, điều này trong các hợp đồng 4 năm trở lên trước đây không phải là chuyện phổ biến.

Bao tiêu dài hạn (Long-Term Offtakes)

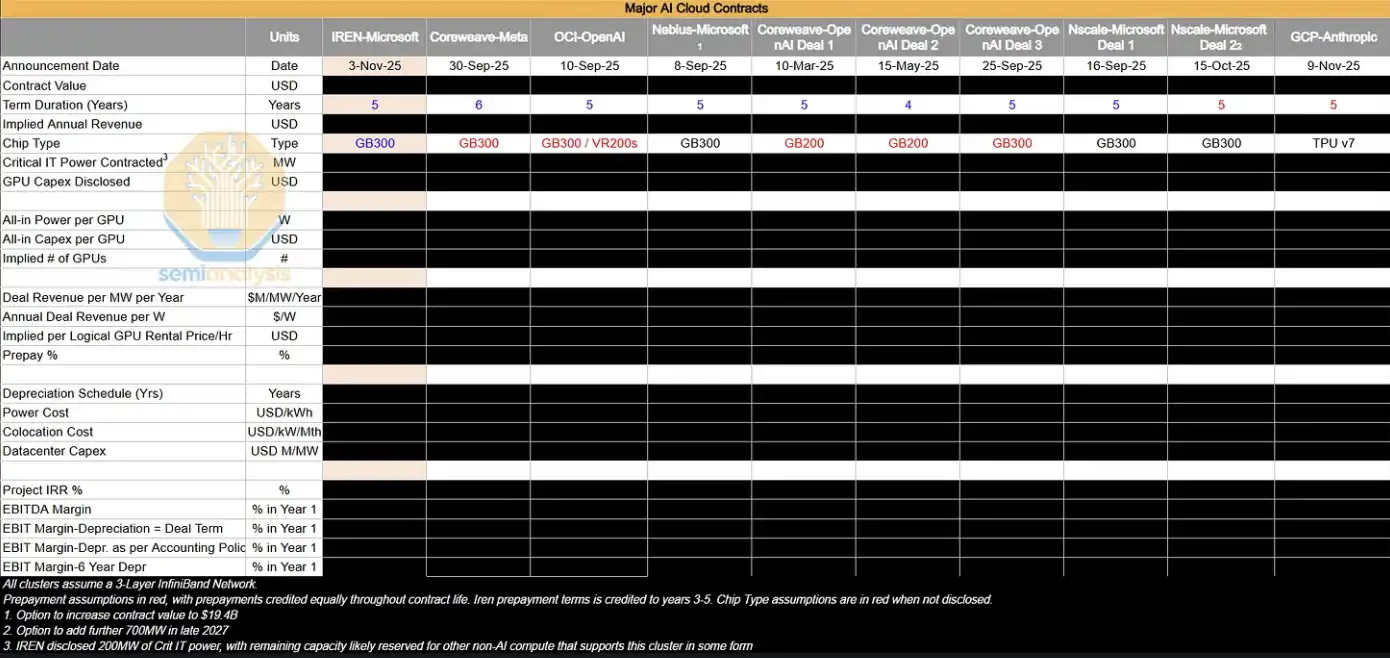

Trong thị trường kỳ hạn dài hơn 4–5 năm, lực lượng chủ đạo là các phòng thí nghiệm AI lớn, chúng sẽ khóa sớm các nguồn năng lực tính toán quy mô lớn. Loại giao dịch này thường tương ứng với các cụm quy mô 50MW, 100MW thậm chí lớn hơn, tương đương khoảng 24k đến 48k GPU GB300 NVL72. Nhìn tổng thể, các thỏa thuận bao tiêu dài hạn này đã chiếm một phần đáng kể trong thị trường thuê GPU của Neocloud.

Các phòng thí nghiệm AI ưa chuộng các hợp đồng kiểu này vì họ có thể khóa một lần lượng lớn năng lực tính toán để đáp ứng nhu cầu ở đầu cuối tăng nhanh. Đồng thời, các tổ chức này thường tham gia sâu vào thiết kế cụm, bao gồm các hạng mục then chốt như lưu trữ, mạng, cấu hình CPU. Những giao dịch này thường được giao dưới dạng kim loại trần (bare metal), bởi các phòng thí nghiệm AI có đủ năng lực kỹ thuật để tùy chỉnh stack công nghệ ở tầng sâu hơn, từ đó đạt TCO (Tổng chi phí sở hữu) và hiệu năng tối ưu.

Đối với nhà cung cấp Neocloud, loại giao dịch này cũng hấp dẫn. Một mặt, họ có thể tập trung nguồn lực bán hàng vào một vài đơn đặt hàng giá trị lớn thay vì phải xử lý nhiều khách hàng quy mô nhỏ mà vẫn thu được doanh thu tương đương. Mặt khác, hợp đồng dài hạn giúp họ dễ dàng huy động tài chính bằng nợ với điều kiện tốt hơn — bằng cách khớp thời hạn tài trợ với thời hạn hợp đồng, có thể giảm hiệu quả rủi ro lệch kỳ hạn và biến động giá; trong phần lớn trường hợp, còn có thể chốt được tỷ suất hoàn vốn nội bộ (IRR) ở mức “vài chục phần trăm”.

Ngoài ra, các nhà cung cấp đám mây cực lớn (Hyperscalers) cũng thường đóng vai trò “bên mua dự phòng” (backstop) — họ là bên mua trực tiếp từ Neocloud để lấy năng lực tính toán, rồi bán lại cho các phòng thí nghiệm AI. Cấu trúc này mang lại lợi ích đôi bên: Neocloud có thể nhận điều kiện tài trợ tốt hơn dựa trên bên mua có xếp hạng AAA; còn các hyperscalers thì không cần mở rộng bảng cân đối tài sản và nợ phải trả của chính mình, mà vẫn có thể nhận một phần lợi nhuận dự án thông qua việc cung cấp bảo chứng tín dụng.

Bảng dưới đây liệt kê một số thỏa thuận bao tiêu lớn mà chúng tôi đang theo dõi. Chúng tôi sẽ phân tích sâu các giao dịch này để suy ngược ra giá GPU theo giờ ngầm ẩn ($/hr/GPU), cùng các chỉ tiêu lợi nhuận quan trọng như IRR của dự án, biên lợi nhuận EBIT, v.v.

Trong bối cảnh thị trường hiện tại, hầu hết các cụm AI lớn đang mở rộng thực ra đều bị chính các phòng thí nghiệm AI “tiêu thụ nội bộ”. Tuy nhiên, các tổ chức này vẫn sẽ bước vào thị trường hợp đồng trong vòng 4 năm để bổ sung năng lực tính toán, đồng thời thông qua việc gia hạn các cụm H100 và H200 hiện có một cách gián tiếp ngăn nguồn cung không chảy trở lại vào thị trường đó. Khi các cụm siêu quy mô GB200 và GB300 dần được đưa vào vận hành, quan hệ cung cầu trong thị trường kỳ hạn 1–3 năm sẽ biến đổi ra sao sẽ là một biến số đáng đặc biệt theo dõi trong thời gian tới.

“Cái chày sẽ lăn về đâu” (Where The Puck is Going)

Thứ được chú ý nhất hiện tại là sự lệch rõ rệt giữa hiện thực ở tầng nền và tâm lý thị trường. Dù tín hiệu về việc nguồn cung bị siết chặt và giá tăng — vốn lẽ ra có lợi cho Neocloud (mở rộng biên lợi nhuận, kéo dài vòng đời sử dụng tài sản) — đã quá rõ ràng, nhưng thị trường công lại ngày càng bi quan về các công ty như CoreWeave, Nebius, Iris Energy, và giá cổ phiếu của họ hiện vẫn nằm ở mức thấp trong khoảng 6–12 tháng qua.

Thị trường vẫn bị dẫn dắt bởi câu chuyện “cuối cùng sẽ dư cung, năng lực tính toán sẽ bị hàng hóa hóa”, và những thay đổi nói trên chưa thực sự xoa dịu nỗi lo của nhà đầu tư về giá trị dài hạn của GPU. Nhưng xét từ thực tế ở tuyến đầu, tình trạng nguồn cung tiếp tục căng thẳng và quyền định giá được củng cố có nghĩa là gần như toàn bộ năng lực tính toán đang ở trạng thái được nhu cầu “hấp thụ” — dù có khác nhau về hiệu năng, trong bối cảnh thiếu hụt cực đoan hiện nay, vẫn là cung không đáp ứng nổi cầu.

Ba điểm quan sát trong tương lai

Để đánh giá liệu giá thuê GPU có tiếp tục được duy trì ở mức cao hay không, có thể tập trung vào ba biến số:

1、Nhịp độ mở rộng cụm GB300 (2026)

Điểm mấu chốt là tốc độ tương đối giữa năng lực tính toán bổ sung và nhu cầu token — liệu cung sẽ giảm bớt căng thẳng hay nhu cầu tiếp tục vượt xa cung. Điều này sẽ tác động trực tiếp đến việc các phòng thí nghiệm AI có tiếp tục tham gia thị trường trong vòng 4 năm hay không, và xu hướng giá ở phân khúc đó.

2、Tình trạng thiếu hụt chip có ngày càng trầm trọng hơn không

Bao gồm năng lực sản xuất quy trình N3 của TSMC, HBM, DRAM, NAND và các khâu then chốt khác; mọi dao động ở cấp độ thực thi sản xuất đều có thể siết chặt thêm nguồn cung.

3、Tốc độ tăng trưởng doanh thu (ARR) của phòng thí nghiệm AI và tiêu thụ token

Việc mở rộng thương mại hóa AI và quy mô sử dụng sẽ quyết định mức độ mạnh của nhu cầu ở đầu cuối — đây cũng là biến số cốt lõi thúc đẩy nhu cầu năng lực tính toán.

Giá đi lên một chiều, tỷ suất lợi nhuận đi theo tăng lên

Tổng hợp lại, một kết luận tương đối rõ ràng là: xác suất giá thuê GPU tiếp tục tăng cao hơn xác suất giảm.

Quá trình này có đặc điểm khuếch đại tự thân rõ rệt: khi Neocloud nhận thấy cung đang siết chặt và giá tăng, họ sẽ khóa thêm phần cứng trước, từ đó tiếp tục nén nguồn cung trên thị trường, đẩy giá đi lên tiếp. Điều này tương tự chu kỳ thiếu GPU trong năm 2023–2024 — khi đó, tình trạng căng thẳng cung thúc đẩy OEM đạt được mở rộng biên lợi nhuận đáng kể và làm giá máy chủ tăng mạnh (dù mức độ trưởng thành của thị trường lần này cao hơn, nên quá trình này có thể không lặp lại hoàn toàn).

Trong khi đó, việc giá thuê GPU tiếp tục tăng cũng đang cải thiện tỷ suất hoàn vốn trên vốn đầu tư của Neocloud (ROIC):

Một mặt, nâng biên lợi nhuận của tài sản đã được triển khai

Mặt khác, kéo dài chu kỳ sử dụng kinh tế của GPU, để vốn có thể tạo dòng tiền trong thời gian dài hơn

Ai là bên hưởng lợi lớn nhất hiện tại?

Bên hưởng lợi trực tiếp nhất hiện tại là các nhà cung cấp năng lực tính toán có những đặc điểm sau:

· Chủ yếu hợp đồng kỳ hạn ngắn (có thể định giá lại nhanh)

· Sở hữu lượng lớn thiết bị tồn H100

· Trong ngắn hạn có công suất mới đi vào vận hành

Neocloud theo cấu trúc cho thuê ngắn hạn có thể giải phóng hợp đồng cũ nhanh hơn và ký lại với giá cao hơn, từ đó nhanh chóng đạt được mở rộng lợi nhuận. Đồng thời, các nhà cung cấp đám mây cực lớn đã khóa trước năng lực tính toán thế hệ kế tiếp (hợp đồng nhiều năm), cũng như Neocloud, sẽ tiếp tục được hưởng lợi trong chu kỳ tương lai.

Vậy câu hỏi đặt ra là: lần này, liệu có thực sự “khác biệt”?

[Liên kết bản gốc]

Bấm để tìm hiểu tin tuyển dụng của Luồng động BlockBeats

Chào mừng bạn tham gia cộng đồng chính thức của Luồng động BlockBeats:

Nhóm đăng ký Telegram: https://t.me/theblockbeats

Nhóm Telegram giao lưu: https://t.me/BlockBeats_App

Tài khoản Twitter chính thức: https://twitter.com/BlockBeatsAsia