Розробники змушують Claude говорити як печерна людина, щоб скоротити витрати — і це працює

Коротко

- Розробник виявив, що примусити Claude говорити як печерна людина зменшує кількість токенів у відповідях, а отже й витрати, аж до 75%.

- Інтернет одразу перетворив це на GitHub-навичку.

- За таких високих тарифів Anthropic за токени на виході grunt-mode — це вже не жарт, а скоріше стратегія бюджету.

Десь між інженерією промптів і перформанс-артом розробник опублікував на Reddit відкриття, яке змусило спільноту про ШІ сміятися, перш ніж звернути увагу: навчіть Claude спілкуватися як доісторична людина й подивіться, як зменшиться ваш рахунок за токени — до 75%. Пост потрапив у r/ClaudeAI минулого тижня й з того часу зібрав понад 400 коментарів і 10K голосів — рідкісне поєднання справжнього технічного розуміння та абсурдної комедії, за яке інтернет зазвичай винагороджує.

Механіка проста. Замість того щоб давати Claude «розігрітися» з ввічливостями, опишіть кожен крок, який він робить, і заверште пропозицією допомогти далі — розробник обмежує модель короткими, стиснутими реченнями. Спочатку інструмент, спочатку результат, без пояснень. Звичайне завдання вебпошуку, яке працювало б приблизно на 180 токенів на виході, скоротилося до близько 45. Автор оригінального посту стверджує, що зниження вихідних токенів до 75% досягається, змусивши модель звучати так, ніби вона щойно відкрила вогонь.

У термінах печерної людини, як сказав один з реддіторів: "Навіщо витрачати час казати багато слів, коли трохи слів дає потрібний трюк?” Ця техніка не зачіпає контекст на вході: повну історію розмов, прикріплені файли та системні інструкції, які модель перечитує на кожному окремому ході. Цей вхід зазвичай набагато більший за вихід, особливо в довших сесіях із кодуванням. Реальні сесії, які рахують весь цей вхід, дають заощадження близько 25%, а не 75%. Все одно істотно, просто це не заголовкова цифра. Також розумна ідея — подавати моделі нормальні інструкції. Не давайте їй розмови «як печерній людині», бо це може спірально звести все до ситуації “сміття на вході — сміття на виході”.

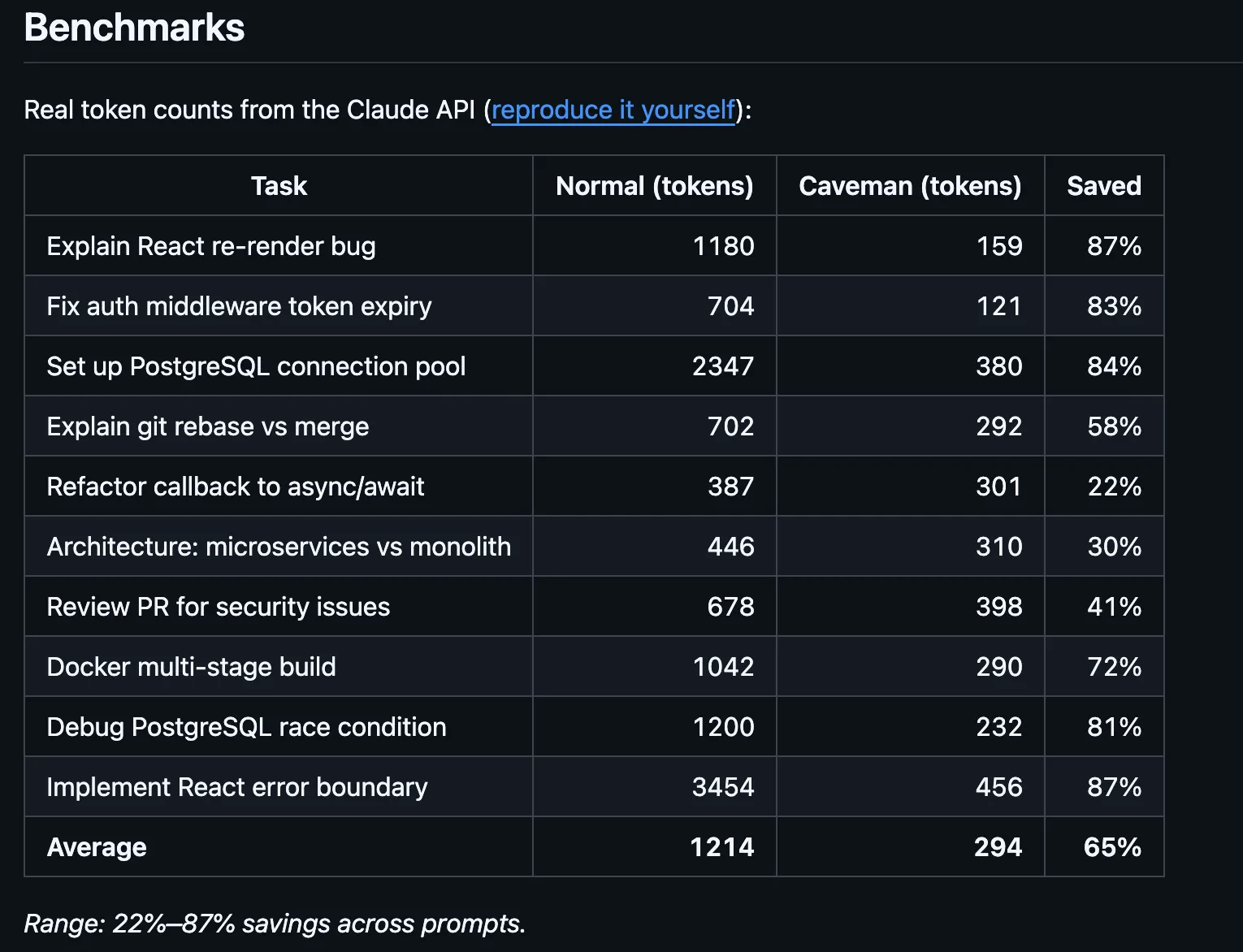

Є також питання деградації інтелекту. Кілька дослідників у треді сперечалися, що примушення ШІ втілювати менш продуману персоніфікацію може активно шкодити якості його міркувань — мовні обмеження можуть «просочитися» в когнітивні процеси. Питання ще не було остаточно вирішено, але врахувати це варто, оцінюючи результати. Навичка класна — навичка розлітається вірусно Попри застереження, техніка майже одразу отримала друге життя на GitHub. Розробник Shawnchee упакував правила в окрему caveman-skill, сумісну з Claude Code, Cursor, Windsurf, Copilot і більш ніж 40 іншими агентами. Навичка зводить підхід до 10 правил: без фраз-паразитів, виконувати перед поясненням, без метакоментарів, без передмови, без післямови, без повідомлень про інструменти, пояснювати лише коли треба, хай код говорить сам за себе, і розглядати помилки як те, що треба виправити, а не як те, що треба озвучувати. Бенчмарки в репозиторії, перевірені через tiktoken, показують зменшення кількості вихідних токенів на 68% для задач вебпошуку, 50% для правок коду та 72% для обміну запитання-відповідь — тобто в середньому на 61% зменшення виходу для чотирьох стандартних задач. Паралельний репозиторій від розробника Julius Brussee використав трохи інший підхід: він оформив ту саму ідею як файл SKILL.md з 562 зірками на GitHub. Специфікація: відповідай як розумна печерна людина, прибирай артиклі, наповнювачі й ввічливості, зберігай усе технічне наповнення. Блоки коду лишаються без змін. Повідомлення про помилки цитуються дослівно. Технічні терміни зберігаються. Печерна людина говорить лише англійською «обгорткою» навколо фактів.

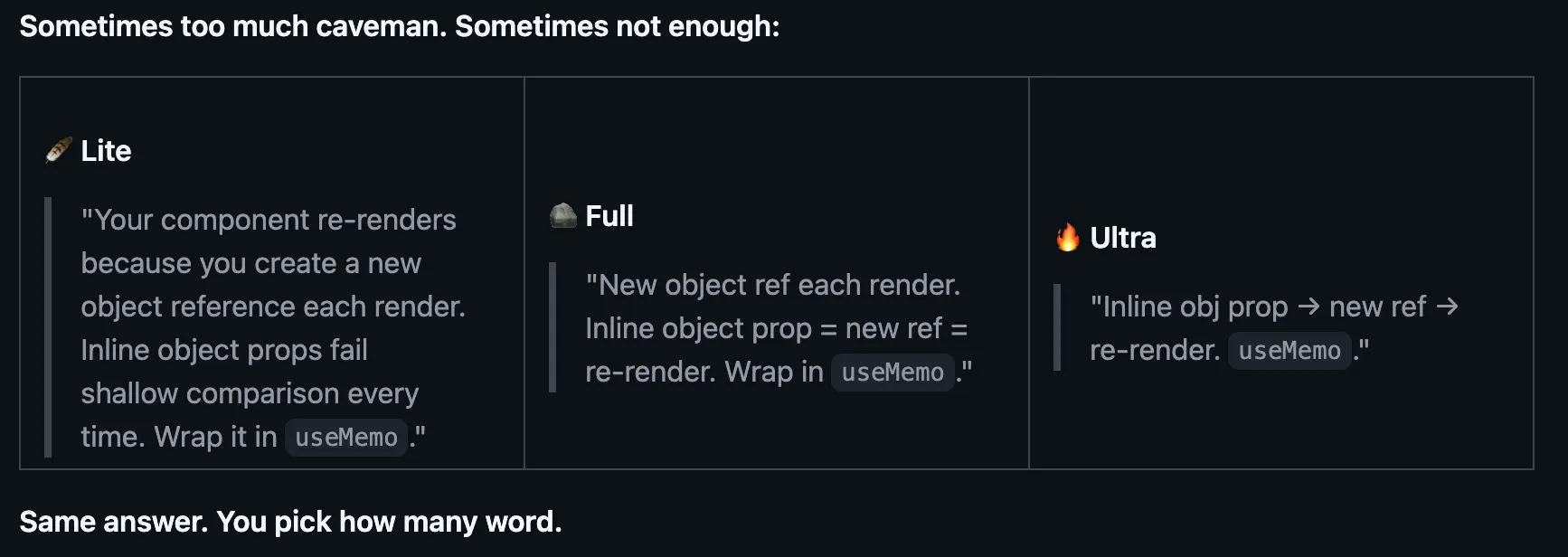

Ця версія ще й має різні режими, щоб впливати на те, наскільки сильно ви хочете все скорочувати: перемикання між Normal, Lite та Ultra. Моделі виконують абсолютно ту саму роботу, але дають набагато коротшу відповідь, що з часом дає велику економію.

Ширший контекст витрат робить жарт гострішим. Anthropic — серед найдорожчих моделей за ціною за токен. Для розробників, які запускають агентні робочі процеси з десятками ходів на сесію, багатослівність на виході — це не стилістична претензія. Це рядок витрат. Якщо грубувата «печерна» крикалка може замінити п’ятифразове резюме того, що щойно зробила модель, то зекономлені токени накопичуються під час тисяч викликів API. Печерну навичку можна встановити однією командою через skills.sh, і вона працює глобально в межах проєктів. Незалежно від того, чи робить це Claude трохи менш розбірливою, вона вже суттєво зменшила роздратування у багатьох розробників.