AI企業Anthropic、ユーザーの「誤用」を防ぐために化学兵器の専門家を募集==================================================================1日前シェア保存ゾーイ・クラインマン テクノロジー編集者シェア保存Getty Images米国の人工知能(AI)企業Anthropicは、そのソフトウェアの「壊滅的な誤用」を防ぐために、化学兵器や高性能爆薬の専門家を採用しようとしています。つまり、同社はAIツールが化学兵器や放射性兵器の作り方を誰かに教える可能性を懸念しており、そのガードレールが十分に堅牢であることを保証する専門家を求めているのです。LinkedInの採用投稿では、応募者は「化学兵器および/または爆発物防衛」に最低5年の経験を持ち、「放射線散布装置」(いわゆるダーティボム)についての知識も必要としています。同社はBBCに対し、この役割はすでに作成している他の敏感分野の仕事と類似していると述べました。Anthropicはこの戦略を採用している唯一のAI企業ではありません。同様のポジションは、ChatGPTの開発者であるOpenAIも募集しています。同社のキャリアページには、「生物・化学リスク」の研究者の求人が掲載されており、給与は最大45万ドル(約3,350万円)と、Anthropicのほぼ倍の額となっています。しかし、一部の専門家はこのアプローチのリスクに警鐘を鳴らしており、AIツールが武器に関する情報を持つこと自体が危険だと指摘しています。たとえ使用しないよう指示されていてもです。「AIシステムを使って、ダーティボムやその他の放射線兵器を含む敏感な化学物質や爆発物の情報を扱うことは安全なのか?」と、テック研究者でBBCのAI Decoded TV番組の共同司会者であるステファニー・ヘア博士は述べています。「この種の作業に関する国際条約や規制はなく、これらの兵器に関するAIの使用はすべて見えないところで行われています。」AI業界はこれまで、技術がもたらす潜在的な存在的脅威について警告してきましたが、その進展を抑制しようとする動きは見られません。この問題は、米国政府がイランとの戦争やベネズエラでの軍事作戦を展開する中で、AI企業に対して警鐘を鳴らす動きとして緊急性を増しています。LinkedIn米国のAI企業Anthropicの求人広告は、化学兵器と高性能爆薬の専門家を募集し、政策チームに参加させることを目的としています。Anthropicは、米国防総省に対して法的措置を取っています。同省は、同社のシステムが完全自律型兵器や米国人の大量監視に使用されるべきではないと主張したため、供給チェーンリスクとして指定しました。Anthropicの共同創設者ダリオ・アモデイは2月に、「この技術はまだ十分ではなく、これらの目的に使用すべきではない」と述べています。ホワイトハウスは、米軍はテック企業の管理下には置かれないと述べています。このリスクのラベル付けにより、米国企業は中国の通信大手Huaweiと同じ立場に置かれ、国家安全保障上の懸念からブラックリスト入りしています。OpenAIは、Anthropicの立場に同意すると述べましたが、その後、米国政府との契約を交渉し、まだ開始されていないとしています。AnthropicのAIアシスタント「Claude」はまだ廃止されておらず、現在もPalantirが提供するシステムに組み込まれ、米国とイスラエルのイラン戦争において展開されています。大手テック企業、トランプ政権との戦いでAnthropicを支援--------------------------------------------------------------Anthropic、米国政府をリスクとして提訴--------------------------------------------------AI安全性のリーダー、「世界は危機に瀕している」と述べて辞任、詩の研究へ-------------------------------------------------------------------世界のトップテックニュースやトレンドを追うために、「Tech Decoded」ニュースレターに登録しましょう。英国外にお住まいの方はこちらから登録してください。人工知能軍事

AI企業Anthropicが、ユーザーによる「悪用」を防ぐため兵器専門家を募集

AI企業Anthropic、ユーザーの「誤用」を防ぐために化学兵器の専門家を募集

1日前

シェア保存

ゾーイ・クラインマン テクノロジー編集者

シェア保存

米国の人工知能(AI)企業Anthropicは、そのソフトウェアの「壊滅的な誤用」を防ぐために、化学兵器や高性能爆薬の専門家を採用しようとしています。

つまり、同社はAIツールが化学兵器や放射性兵器の作り方を誰かに教える可能性を懸念しており、そのガードレールが十分に堅牢であることを保証する専門家を求めているのです。

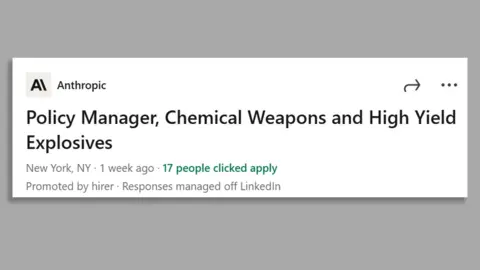

LinkedInの採用投稿では、応募者は「化学兵器および/または爆発物防衛」に最低5年の経験を持ち、「放射線散布装置」(いわゆるダーティボム)についての知識も必要としています。

同社はBBCに対し、この役割はすでに作成している他の敏感分野の仕事と類似していると述べました。

Anthropicはこの戦略を採用している唯一のAI企業ではありません。

同様のポジションは、ChatGPTの開発者であるOpenAIも募集しています。同社のキャリアページには、「生物・化学リスク」の研究者の求人が掲載されており、給与は最大45万ドル(約3,350万円)と、Anthropicのほぼ倍の額となっています。

しかし、一部の専門家はこのアプローチのリスクに警鐘を鳴らしており、AIツールが武器に関する情報を持つこと自体が危険だと指摘しています。たとえ使用しないよう指示されていてもです。

「AIシステムを使って、ダーティボムやその他の放射線兵器を含む敏感な化学物質や爆発物の情報を扱うことは安全なのか?」と、テック研究者でBBCのAI Decoded TV番組の共同司会者であるステファニー・ヘア博士は述べています。

「この種の作業に関する国際条約や規制はなく、これらの兵器に関するAIの使用はすべて見えないところで行われています。」

AI業界はこれまで、技術がもたらす潜在的な存在的脅威について警告してきましたが、その進展を抑制しようとする動きは見られません。

この問題は、米国政府がイランとの戦争やベネズエラでの軍事作戦を展開する中で、AI企業に対して警鐘を鳴らす動きとして緊急性を増しています。

米国のAI企業Anthropicの求人広告は、化学兵器と高性能爆薬の専門家を募集し、政策チームに参加させることを目的としています。

Anthropicは、米国防総省に対して法的措置を取っています。同省は、同社のシステムが完全自律型兵器や米国人の大量監視に使用されるべきではないと主張したため、供給チェーンリスクとして指定しました。

Anthropicの共同創設者ダリオ・アモデイは2月に、「この技術はまだ十分ではなく、これらの目的に使用すべきではない」と述べています。

ホワイトハウスは、米軍はテック企業の管理下には置かれないと述べています。

このリスクのラベル付けにより、米国企業は中国の通信大手Huaweiと同じ立場に置かれ、国家安全保障上の懸念からブラックリスト入りしています。

OpenAIは、Anthropicの立場に同意すると述べましたが、その後、米国政府との契約を交渉し、まだ開始されていないとしています。

AnthropicのAIアシスタント「Claude」はまだ廃止されておらず、現在もPalantirが提供するシステムに組み込まれ、米国とイスラエルのイラン戦争において展開されています。

大手テック企業、トランプ政権との戦いでAnthropicを支援

Anthropic、米国政府をリスクとして提訴

AI安全性のリーダー、「世界は危機に瀕している」と述べて辞任、詩の研究へ

世界のトップテックニュースやトレンドを追うために、「Tech Decoded」ニュースレターに登録しましょう。英国外にお住まいの方はこちらから登録してください。

人工知能

軍事