開発者たちはコスト削減のためClaudeに原始人のように話させている――そしてそれは機能している

要約

- 開発者が、Claudeに「原始人のように話すよう無理に強制すると」出力トークンが減り、その結果コストが最大75%削減されることを発見した。

- インターネットは即座にそれをGitHubのスキルにした。

- Anthropicが出力トークンごとに非常に高額に課金しているため、grunt-modeは単なる冗談というより、予算戦略になっている。

プロンプトエンジニアリングとパフォーマンスアートの間あたりで、開発者がRedditに発見を投稿し、AIコミュニティは、注意を払う前に笑った:Claudeに先史時代の人間のようにコミュニケーションさせれば、トークン請求額が最大75%縮むのだと教えよう。 その投稿は先週r/ClaudeAIにヒットし、それ以降400件以上のコメントと10K票を獲得した――まれに見る、「本物の技術的洞察」と「ナンセンスなコメディ」が両立した組み合わせで、インターネットはそういうものを報酬として与えがちだ。

仕組みはシンプルだ。Claudeが挨拶でウォームアップするのを許す代わりに、Claudeが行うあらゆるステップをすべてナレーションし、さらに手伝う用意を示して締めることで、開発者はモデルを短く削ぎ落とした文に制約する。ツール優先、結果優先、説明なし。通常のWeb検索タスクで約180出力トークンかかるところが、約45にまで落ちた。投稿者は、モデルに「火を発見したばかり」のような響きをさせることで、出力を最大75%削減できると主張している。

原始人の言葉で言えば、あるRedditorがこう言っていた:「たくさんの言葉で時間を無駄にするより、少ない言葉でコツを掴めばいいのに?」 この手法が触れないのは入力コンテキストだ。つまり、完全な会話履歴、添付ファイル、そしてモデルが毎ターン読み直すシステム指示である。この入力は、特に長めのコーディングセッションでは、通常出力をはるかに上回る。実世界のセッションでこれらすべてをカウントすると、節約は約25%で、75%ではない。とはいえ意味はある、ただし見出しの数字ではない。 また、モデルに「通常の指示」を与えるのも良い考えだ。「原始人」の会話術を教えるのはやめたほうがよい。そうしないと「ゴミを入れればゴミが出る(garbage in, garbage out)」という状況に渦巻いていく可能性があるからだ。

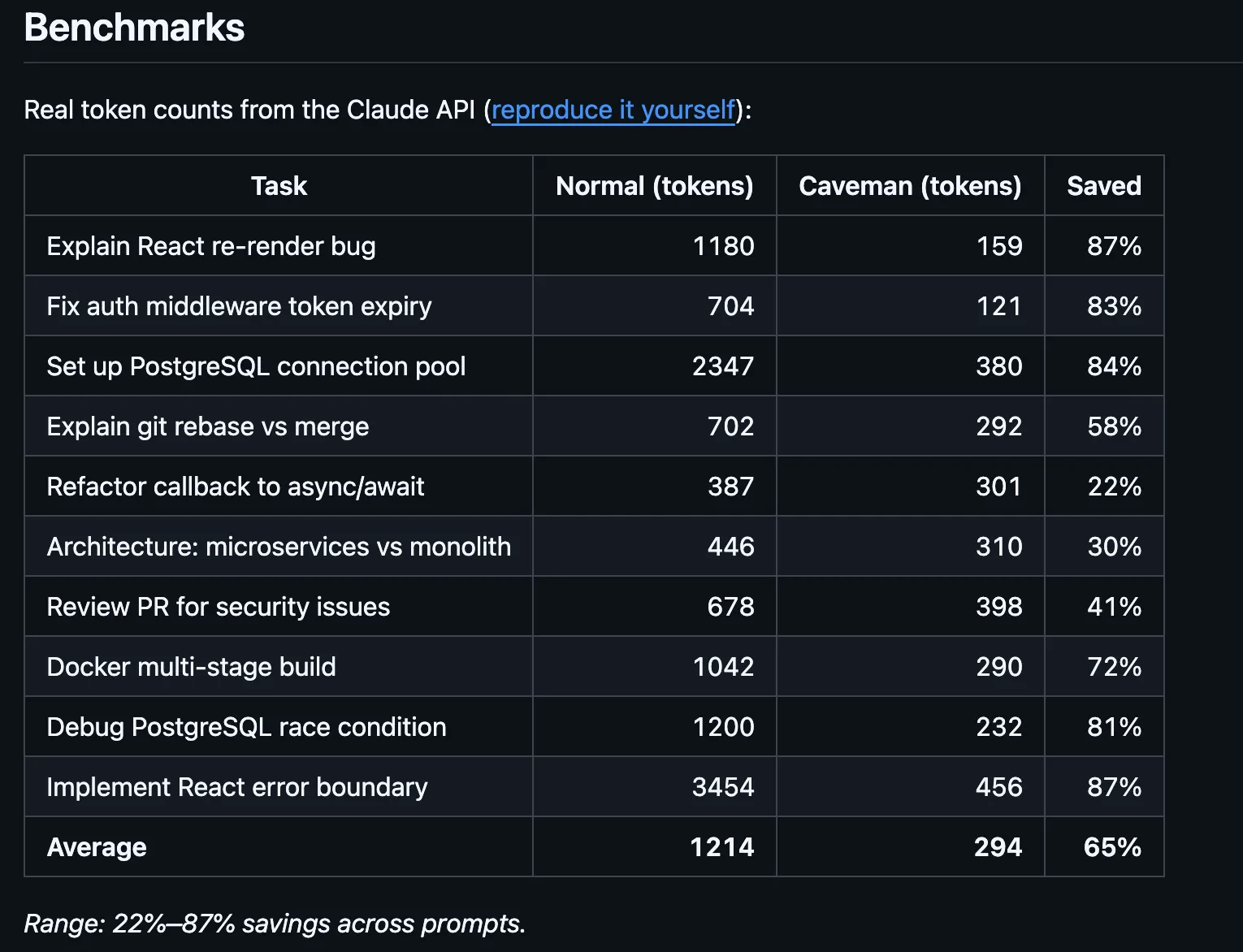

知能の劣化という問題もある。スレッド中の少数の研究者は、AIにより洗練されていない人格を住まわせるよう強制することは、推論の質をむしろ損なう可能性がある、という見解を述べた――言語的な制約が認知のほうへ漏れ出すかもしれない、という懸念だ。懸念は明確に決着がついているわけではないが、結果を評価する際には考慮する価値がある。 スキルは良い、スキルはバズる 注意点はあるにせよ、この手法はほぼすぐにGitHubで第二の命を得た。 開発者Shawncheeは、このルールをClaude Code、Cursor、Windsurf、Copilot、そして40以上の他のエージェントと互換なスタンドアロンの「原始人スキル」としてパッケージ化した。このスキルはアプローチを10のルールに凝縮する:フィラー句なし、説明の前に実行、メタ解説なし、前置きなし、後置きなし、ツールのアナウンスなし、必要なときだけ説明する、コードが自分で語るようにし、エラーは語るのではなく直すべきものとして扱う。 リポジトリ内のベンチマークはtiktokenで検証されており、Web検索タスクで出力トークンが68%削減、コード修正で50%削減、質問と回答のやり取りで72%削減――4つの標準タスクにわたる平均の出力削減は61%となっている。

開発者Julius Brusseeによる並行リポジトリでは、少し違うアプローチが取られており、同じアイデアをGitHubで562のスターが付いたSKILL.mdファイルとして提示している。仕様:賢い原始人のように返答する、記事・フィラー・愛想(ご挨拶)を削る、技術的な本質はすべて保持する。コードブロックは変更されない。エラーメッセージは正確に引用される。技術用語はそのまま維持される。原始人は、事実の周りにある英語のラッパーだけを話す。

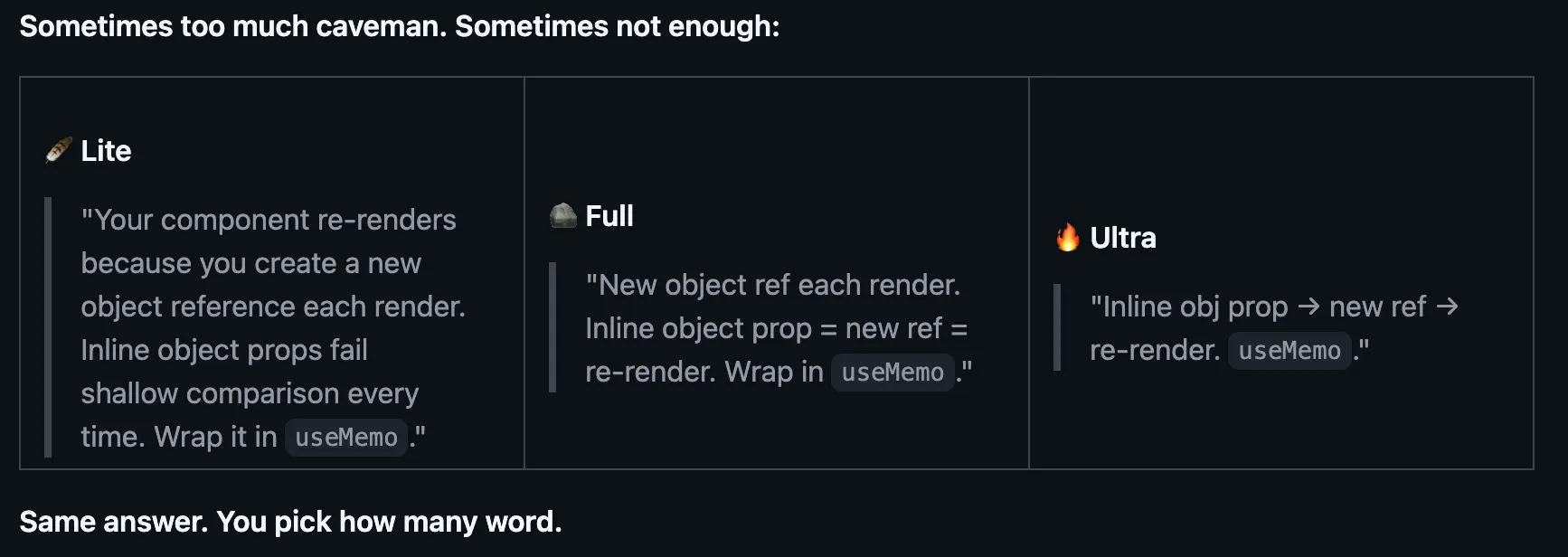

これはさらに、どれだけ削ぎ落としたいかに影響する異なるモードも付いている。Normal、Lite、Ultraの間で切り替える。モデルはまったく同じ作業を行うが、はるかに短い回答を返すため、時間の経過とともに大きな節約になる。

より広いコストの文脈が、この冗談に鋭い切れ味を与える。Anthropicは、トークンあたりの価格という点で最も高価なモデルの一つだ。セッションごとに何十ものターンがあるエージェント的ワークフローを動かす開発者にとって、出力の冗長さは「好みの文句」ではない。費目(ラインアイテム)だ。原始人のぐるんが、モデルが直前にやったことの5文要約の代わりになれるなら、節約できたトークンは、何千ものAPIコールにわたって積み上がっていく。 原始人スキルは、skills.shで1コマンドによりインストールでき、プロジェクト全体でグローバルに動作する。Claudeがわずかに饒舌さに欠けるようになるかどうかにかかわらず、すでに多くの開発者を明確にイライラさせにくくしている。